苹果&SpaceX前工程师分享o1使用心得,奥特曼、Brockman都转发了。

划重点:

o1已经不是聊天模型了,需要全新的使用方法。

奥特曼还跑去挖坟作者Ben Hylak数天前的“自我打脸”评论,称“观察o1的口碑变化、以及人们学习如何使用它很有趣”。

Ben Hylak曾任SpaceX软件工程师、苹果VisionOS人机交互设计师,目前在创业为AI产品提供分析服务。

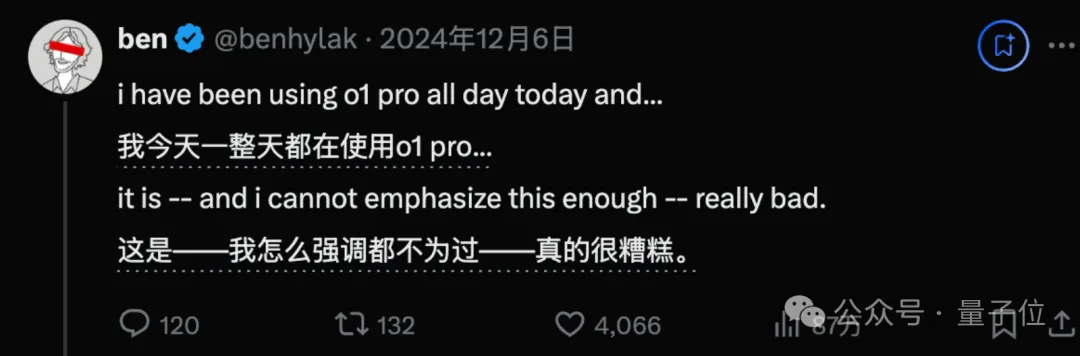

具体来说,Ben在o1 pro推出满血$200/月版本的第一天就交钱了,整整测试了一天后得出结论:它真的很糟糕!

Ben把糟糕的体验发在网上后,很多人表示同感。但有趣的是,也有人强烈反对。

他开始与持不同观点的讨论,然后意识到原来是自己的方法完全错了。

我还在把o1当聊天模型来用,但o1已经不是聊天模型了。

现在,Ben已经从讨厌o1,转变成了每天都在用它解决最重要的问题。

如果说o1不是聊天模型了,那它现在是什么?

Ben认为它就像一个“报告生成器”。如果你给它足够的上下文,并告诉它你想要输出什么,它通常会一次性找到解决方案。

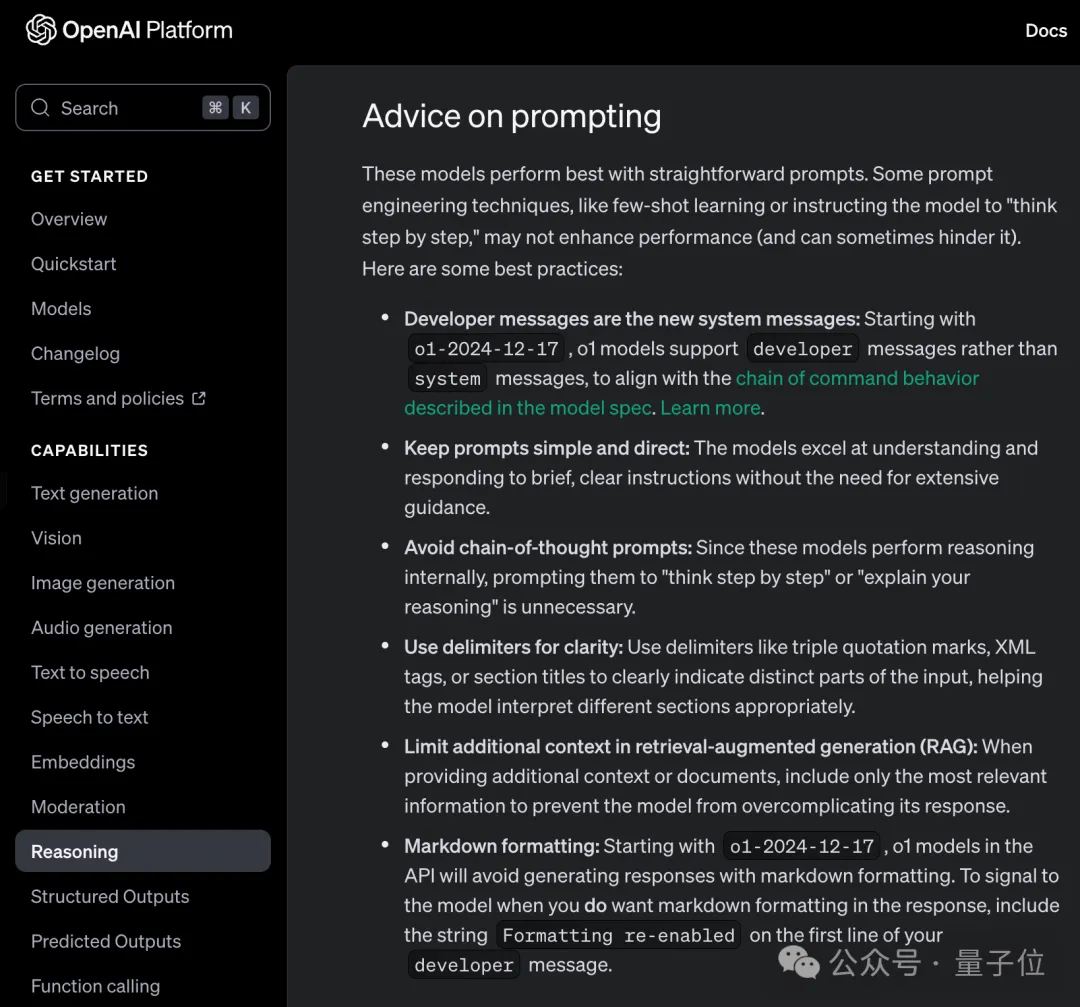

OpenAI官方其实给了一个简单的o1使用建议,但并不完善。

Ben的建议包括:

不管你现在是怎么理解“海量”的,再乘以10倍。

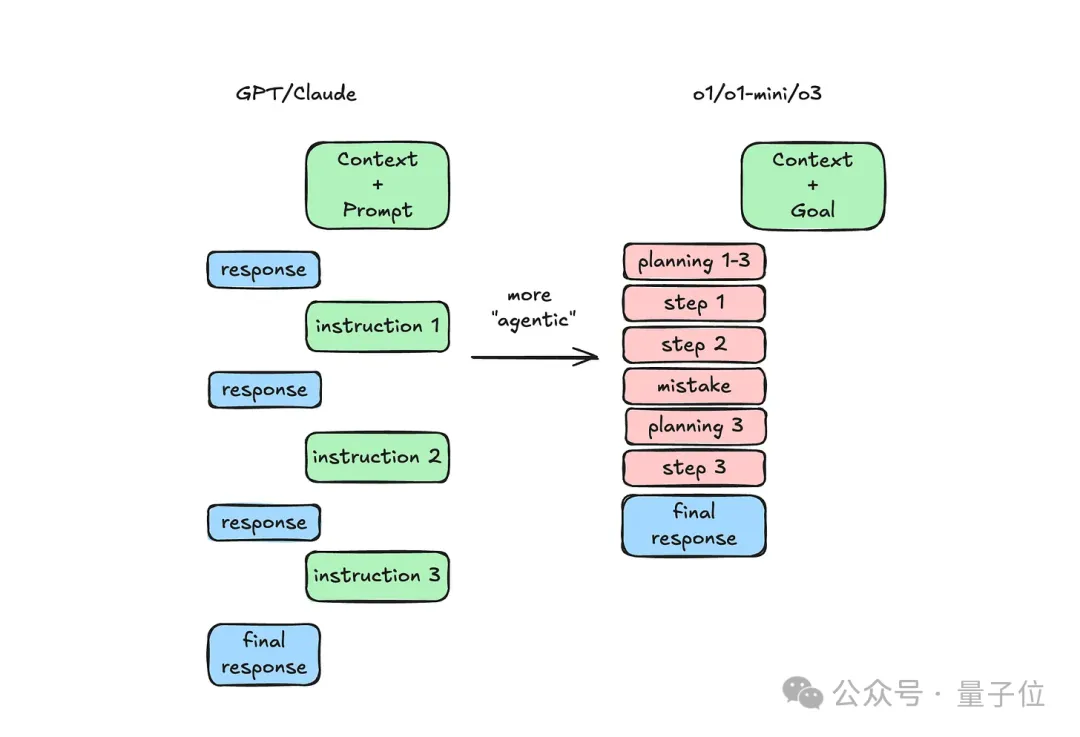

当使用GPT-4o或Claude 3.5等聊天模型时,通常会从一个简单的问题和一些背景信息开始。如果模型需要更多背景信息,它通常会要求你继续提供。

这就是聊天模型的本质,从一来一回的交互中不断完善输出。

但o1只会从表面上回答你提出的问题,不会试图从你那里获取背景信息。所以需要反过来将尽可能多的上下文主动发给它。

即使只是问一个简单的代码工程问题,应该提供:

总而言之,就像对待新员工一样对待o1。

对于大多数聊天模型,我们都会告诉模型希望他如何回复模式,比如“扮演一位软件工程专家,请仔细思考”。

但在o1上有效的方法正相反,告诉它你需要什么,而不是指导它如何去做。

Ben把o1的提示词模板分成4部分:

最后,o1的输出有一种学术/商业报告的风格。Ben认为太多的推理token让它很难摆脱这种风格

他曾试图让o1来完成这篇文章,但经过多次尝试,只能得到非常平淡的学生作业。

在奥特曼的转发推文中,有人套出了最新消息:

o3暂时还不会向用户开放,o3-mini会先推出,而且时间不远了。

o3-mini会先提供给Plus订阅用户使用,API的定价OpenAI内部还没确定,但不会很贵。

参考链接:

[1]https://www.latent.space/p/o1-skill-issue

[2]https://x.com/sama/status/1877814065088663763

[3]https://x.com/gdb/status/1878489681702310392

文章来微信公众号 “量子位”,作者“梦晨”

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0