该工作由南洋理工大学陶大程教授团队与武汉大学罗勇教授、杜博教授团队等合作完成。

近些年,多模态大语言模型(MLLMs)在视觉问答、推理以及 OCR 等任务上取得了显著的成功。

然而,早期的 MLLMs 通常采用固定的分辨率(例如 LLaVA-v1.5 将输入图像缩放为),

对于输入图像为高分辨率图像(例如 8K 分辨率)会导致图像变得模糊,损失大量有效的视觉信息。

为了解决上述问题,目前的解决方案分为三类:

为了探究将 RAG 应用于 MLLM 的高分辨率图像感知,研究人员提出了三个问题:

1. 检索出来的图像块如何布局?

2. 检索的图像块数量对最终性能的影响如何?

3. 如何基于上述发现,将 RAG 更好的应用于 MLLMs 对高分辨率图像的感知?

检索出来的图像块布局方式

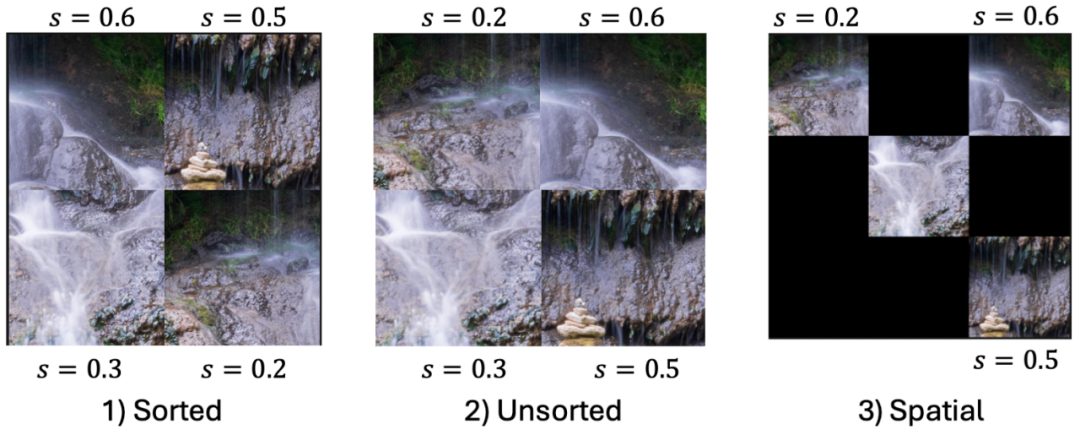

为了探究检索图像块布局的影响,研究人员设计了三种策略:

1)按照检索的分数从高到低进行排列;2)按照原始顺序进行排列和 3)维持检索图像块的相对位置关系。具体的布局例子见下图。

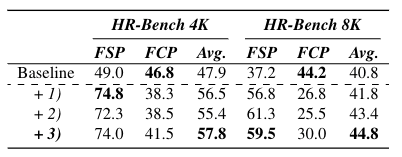

如下表所示,在三种布局方案中,对于单实例感知任务(FSP)都有显著提升,然而 1)和 2)在跨实例感知任务(FCP)上相较于 baseline 有明显性能下降。

而 3)由于维持了图像块之间的相对位置关系,因此 3)在 FCP 任务上在三种策略中取得更好的效果。

结论 1: 维持检索图像块之间的相对位置关系是有必要的,特别是对于需要空间感知的任务。

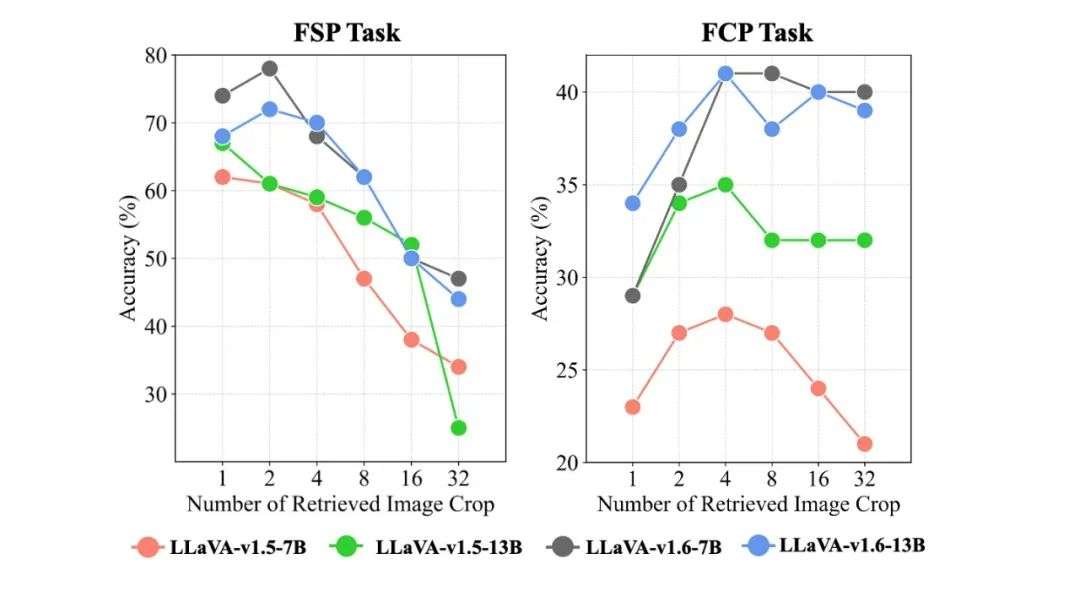

检索的图像块数对最终性能的影响

为了探究检索的图像块数的影响,研究人员使用 LLaVA-v1.5 和 LLaVA-v1.6 7B & 13B 在高分图像感知评测数据集 HR-Bench 上进行实验。

如下图所示,当检索的数量 (K) 增加时,由于提供了更多的视觉信息,在 FCP 任务上的性能逐渐增加。

然而,当K增加时,输入图像的分辨率也相应增加,导致模型输出的结果准确性下降。

相反,对于 FSP 任务而言,较小的 K 便能取得更好的效果,但是在 FCP 任务上效果较差。

结论 2: 不同的任务类型需要保留的图像块数不同。对于 FSP 任务而言,仅需要较少的图像块数便能取得较好的效果,更多的图像块数反而影响模型的性能。

对于 FCP 任务而言,更多的图像块数能够保留足够的视觉信息,但是依旧受到输入图像分辨率的限制。

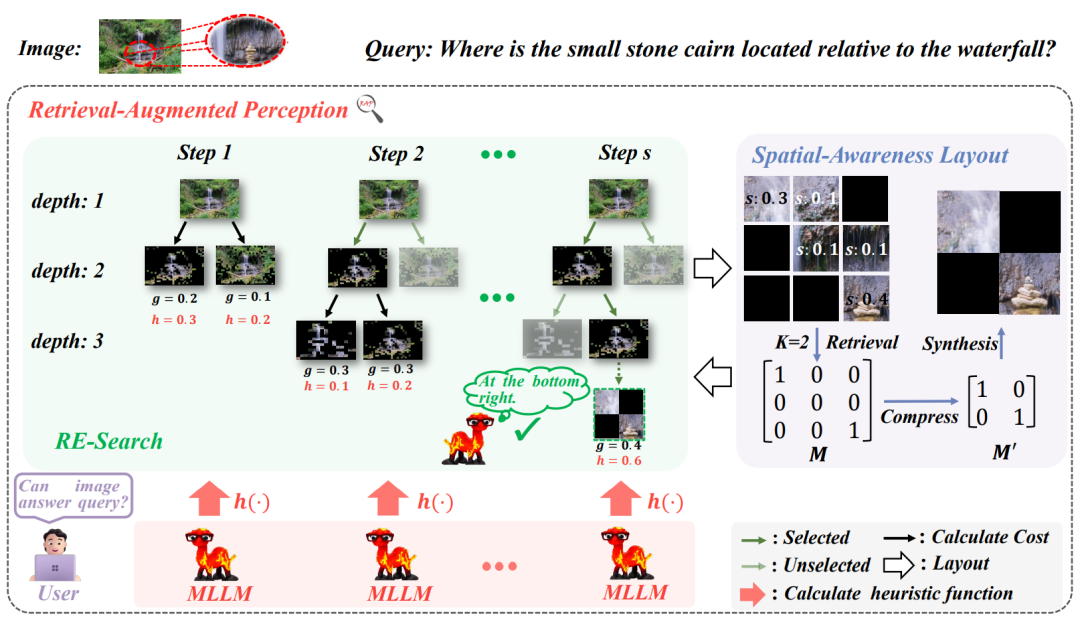

方法

基于上述实验发现,研究人员提出了一种无需训练的高分图像检索增强框架 —— Retrieval-Augmented Perception (RAP)。

RAP 的设计原理是通过检索和用户问题相关的图像块,代替原始的高分辨率图像输入到 MLLMs 中。

该方法有效地降低输入图像的分辨率,并且保留和用户问题相关的关键视觉信息。

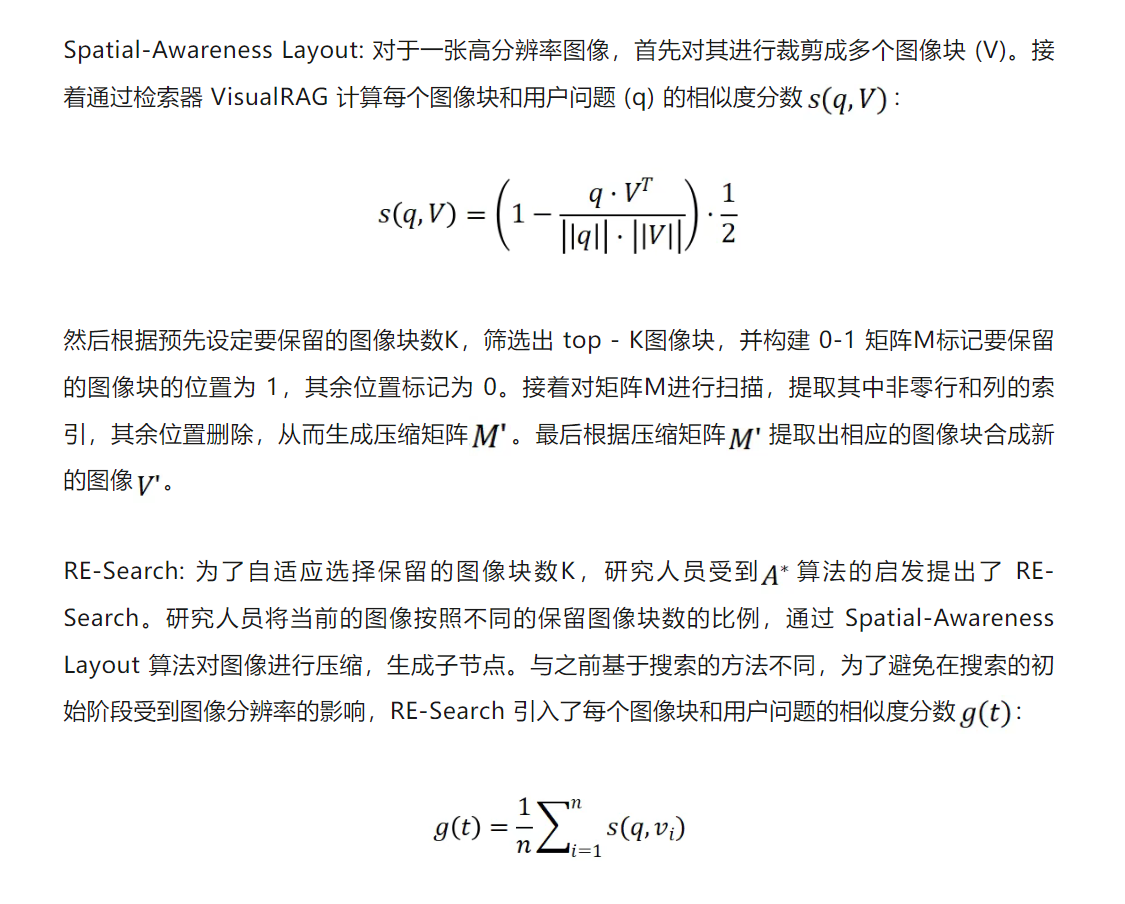

为了维持检索图像块之间的相对位置关系,研究人员设计了 Spatial-Awareness Layout 算法,

通过确定关键的图像块的位置,剔除无效的行和列,在降低图像分辨率的同时,有效保持图像块之间的相对位置关系。

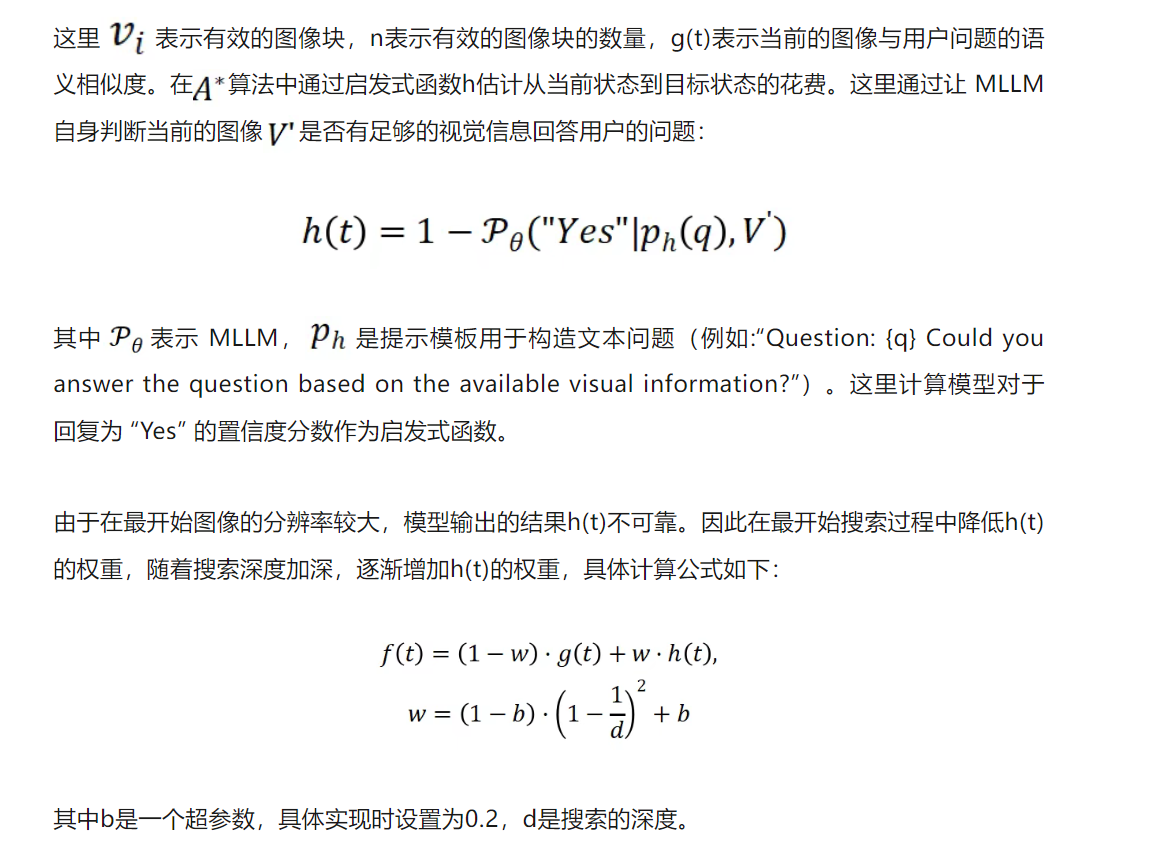

此外,为了自适应选择合适的K,研究人员提出了 Retrieved-Exploration Search (RE-Search),

通过检索的相似度分数和模型的置信度分数作为启发式函数,引导模型搜索合适的K。方法架构图如下图所示:

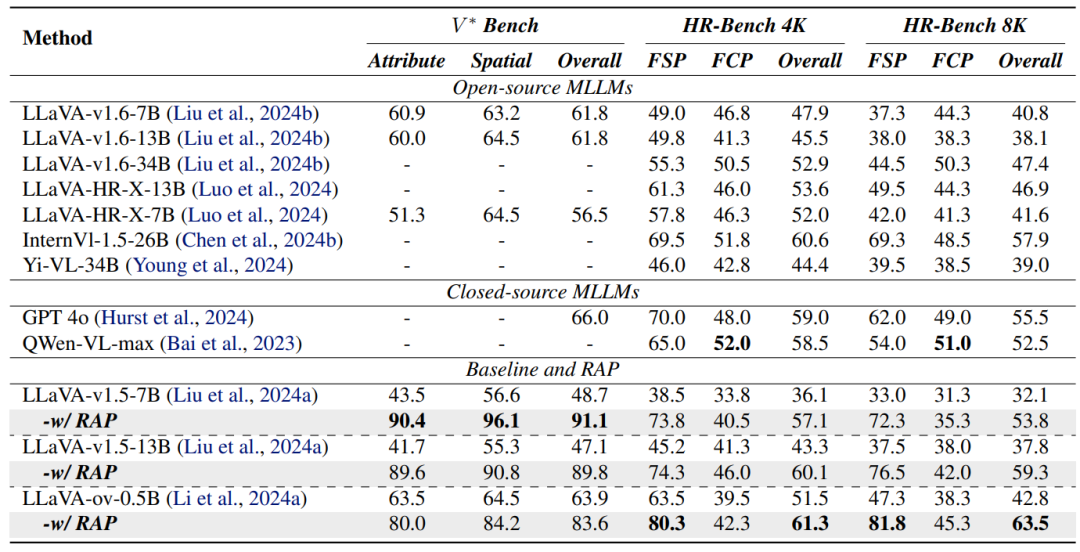

本文在高分辨率图像评测数据集 Bench 和 HR-Bench 上进行评测。

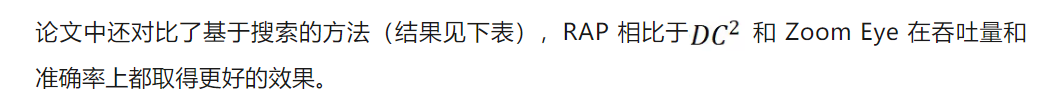

对比的方法包括基于裁剪的方法(LLaVA-v1.6, InternVL-1.5 等)以及使用处理高分辨率图像的视觉编码器的方法(LLaVA-HR-X),实验结果如下表所示,

RAP 在单实例感知和多实例感知任务上都能带来明显的性能提升。特别是在 HR-Bench 4K 和 8K 上分别带来最大 21% 和 21.7% 的准确率提升。

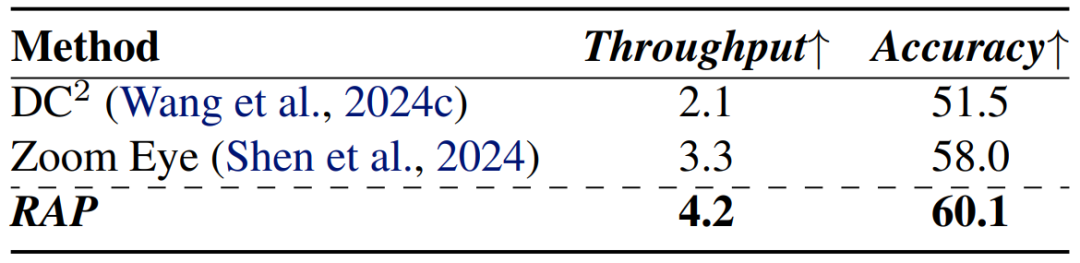

此外,消融实验表明 (见下表),如果仅加入 VisRAG 检索和用户问题相关的图像块,仅带来 6.5% 的提升,

通过维持检索图像块之间的相对位置关系在 FCP 任务上能够有所改进。通过引入 RE-Search 自适应选择合适的K,最终能够带来 21.7% 的性能提升。

总结

综上,该工作提出了 Retrieval-Augmented Perception (RAP),一种无需训练基于 RAG 技术提高 MLLM 对高分辨率图像感知的方法。

该方法使用 Spatial-Awareness Layout 算法维持检索的图像块之间的相对位置信息,通过 RE-Search 自适应选择合适的K值,

在保留关键视觉信息的同时有效降低图像的分辨率。实验结果表明,RAP 在 MLLM 高分辨率图像感知的场景中展现出显著优势。

文章来自于 “机器之心”,作者 :南洋理工大学陶大程教授团队与武汉大学罗勇教授、杜博教授团队等

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI