1986年,图灵奖得主Fred Brooks在软件工程领域提出了著名的"没有银弹"理论:没有任何一种技术或方法能够独自带来软件工程生产力的数量级提升。近四十年后,这个深刻洞察在AI领域再次得到验证——你是否也曾经历过这样的挫折:

图片来自百度百科

💭 花费大量时间精心设计多智能体系统,期待着"1+1>2"的效果,结果却发现性能提升微乎其微,甚至还不如单个模型?

最近一项来自南佛罗里达大学和罗格斯大学的研究揭示了这个问题的根源,并提出了一个名为Know-The-Ropes(KtR)了解门道的解决框架。研究者们通过严格的实验证明,简单地堆叠更多智能体并不能带来预期的性能提升,真正的突破需要基于领域知识的系统性分解。

无免费午餐定理(No Free Lunch Theorem,NFL)由David H. Wolpert和William G. Macready于1997年提出,其核心观点极其简洁却影响深远:

图片来自百度百科

📊 对于所有可能的优化问题,任何两个优化算法的平均性能都是相同的。

这意味着如果算法A在某些问题上表现优于算法B,那么必然存在其他问题使得算法B优于算法A。对于多智能体系统设计而言,这个定理告诉我们追求"万能提示模板"或"通用架构"注定是徒劳的——真正有效的解决方案必须深度结合具体问题的特性和约束条件,利用领域知识来打破"平均性能相等"的魔咒。

💡 这正是KtR框架强调基于领域先验进行系统性分解的理论依据:没有银弹,只有针对特定问题域的最优解决方案。

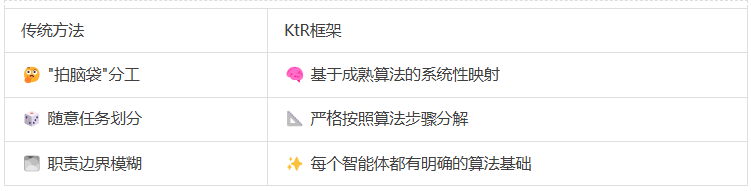

你可能遇到过这样的情况:将一个复杂任务随意分配给多个智能体,结果发现智能体之间职责重叠、边界模糊,甚至相互冲突。

根本原因:

后果:不仅无法提升性能,反而会引入额外的协调成本和错误传播风险。

随着智能体数量的增加,系统的验证成本呈现二次增长趋势,这是许多开发者始料未及的。

关键发现:

这是一个容易被忽视但影响深远的问题:

现象:许多多智能体框架在特定数据集上表现出色,但一旦移除评估泄漏和提示过拟合,性能提升就会急剧下降到个位数百分比。

根源:

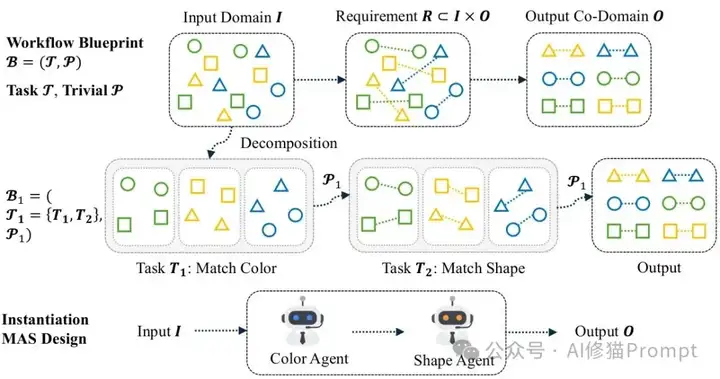

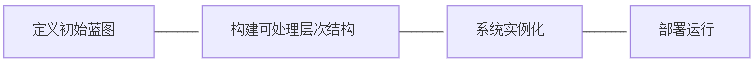

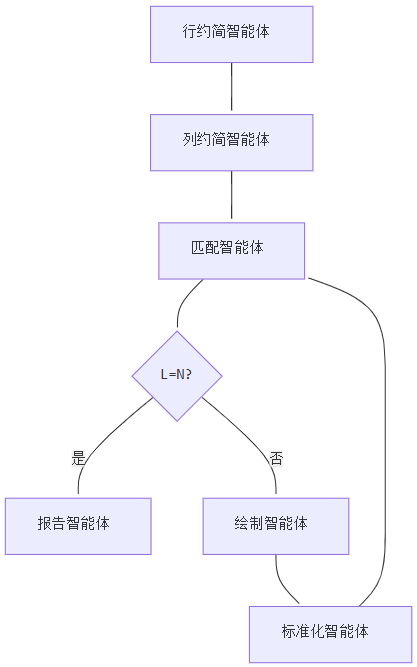

KtR框架的核心思想是将已知的、有效的算法程序转换为连贯的多智能体架构。

KtR框架示意图

KtR框架通过六个精确的数学定义建立了完整的理论基础:

🔑 关键:每个子任务必须能够被现有模型通过零样本或轻量增强(如思维链、微调、自检)可靠地解决。

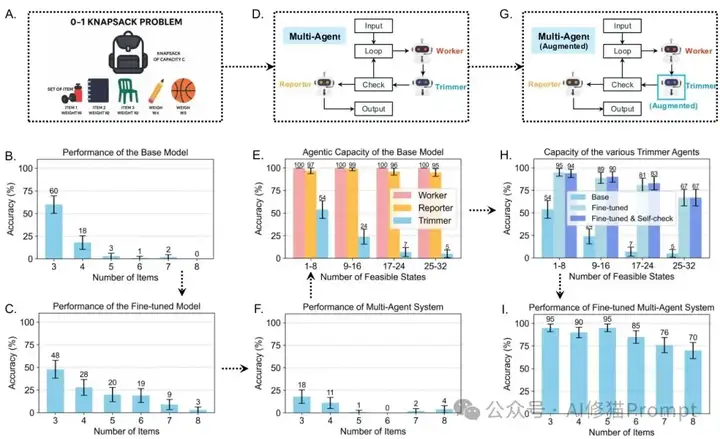

背包问题是计算机科学中的经典优化问题:

📦 给定N个物品(每个有重量和价值)和一个容量限制,目标是选择物品子集使总价值最大且总重量不超过容量。

为什么选择这个问题:

KtR将经典的动态规划算法精确地映射到三个专门智能体上:

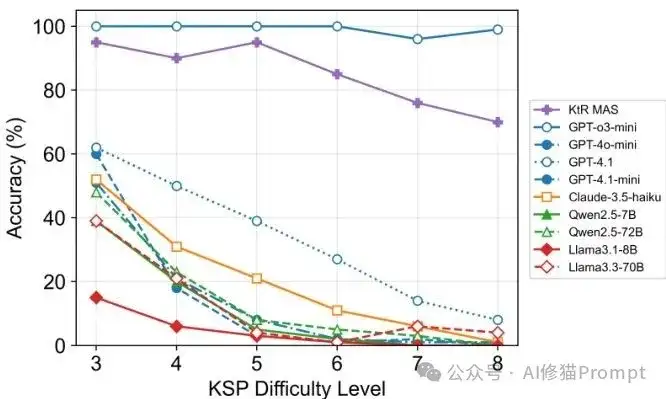

KSP性能对比图

发现瓶颈:

通过系统性的性能分析,研究者发现修剪智能体是整个系统的瓶颈,其准确率随着可行状态数量增加而急剧下降。

精准优化:

仅对修剪智能体进行了轻量级微调(使用1200个训练样例),就将整个系统的准确率从不足18%提升到95%!

KSP详细评估结果

💥 震撼结果:通过精确的瓶颈识别和有针对性的优化,一个由小模型组成的多智能体系统竟然能够达到如此高的性能水平。

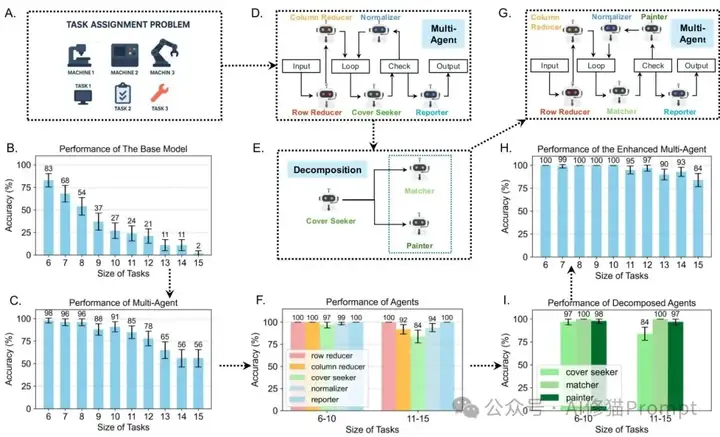

任务分配问题是运筹学中的经典优化问题:

👥 给定n个工人和n个任务,每个工人完成每个任务都有特定的成本,目标是找到一个一对一的分配方案使总成本最小。

匈牙利算法由Harold Kuhn在1955年提出,是解决这类问题的经典多项式时间算法。

算法核心步骤:

实际应用:生产调度、资源分配、物流配送等场景

为了证明KtR框架的可扩展性,研究者使用更强的o3-mini模型,将匈牙利算法分解为六个智能体:

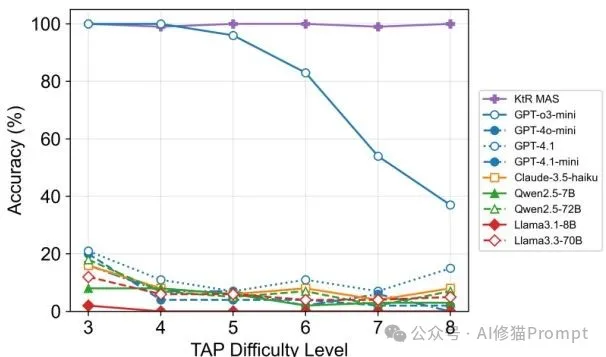

TAP性能对比图

发现新瓶颈:

在初始设计中,研究者发现覆盖寻找任务成为新的瓶颈。

递归分解:

将其进一步分解为匹配和绘制两个子任务。

TAP详细评估结果

结果:

✨ 核心优势:通过系统性的分解和有针对性的优化,可以让多智能体系统的性能随着基础模型能力的提升而同步增长。

KtR框架的提示词设计遵循"精确规范胜过花哨技巧"的原则:

设计要素:

成功关键:这种精确的规范化设计确保了智能体行为的可预测性和系统的稳定性。

KtR框架采用了成熟的软件工程实践:

核心组件:

监控指标:

优化策略:

为了验证KtR框架在实际业务场景中的效果,我基于论文理论实现了一个完整的RFM客户分析系统。

确定性智能体(5个):

LLM智能体(3个):

系统以"某爽肤水专营店"为例,模拟真实电商场景下的客户分析需求。通过行业特定的业务上下文配置,系统能够生成符合护肤品行业特点的客户分群策略和营销建议。

成功验证:

🏆 重要证明:KtR框架不仅在理论上具有说服力,在实际应用中也能够产生真正的商业价值。通过有纪律的分解和精确的智能体设计,小模型也能够在复杂业务场景中发挥出色的分析能力。

KtR框架特别适合那些有明确数学表述和成熟算法解决方案的结构化优化问题:

应用领域:

核心价值:将算法转化为可扩展的多智能体系统,既保持了算法的理论保证,又获得了分布式处理的灵活性。

对于需要多个步骤、有明确依赖关系的复杂决策流程:

典型场景:

关键要求:每个步骤都有明确的输入输出规范和质量标准,便于验证和优化。

KtR框架在需要深度领域知识的专业化任务中展现出独特优势:

应用场景:

共同特点:有明确的专业标准和成熟的方法论,KtR框架能够将这些专业知识系统化地嵌入到多智能体协作中。

最大优势 = 主要限制:对领域知识的强依赖性

挑战:

价值:确保了系统设计的科学性和可靠性

当前验证范围:主要在结构化的优化问题上得到验证

未知领域:

现实定位:KtR框架更适合作为专门模块的设计方法,而不是整个系统的架构基础。

当前状态:仍然需要大量的人工设计和调优工作

需要人工参与的环节:

未来方向:

KtR框架的真正价值不仅在于其具体的技术实现,更在于它重新定义了多智能体系统的设计哲学。

它告诉我们:

对于正在开发Agent产品的你来说,KtR框架提供了一个全新的思路:

🚀 真正的突破不是来自于更大的模型或更多的计算资源,而是来自于更深入的问题理解和更科学的系统设计,从而形成可交付结果的闭环。

这或许就是下一代AI系统的核心竞争力所在。

📝 本文基于论文《Know the Ropes: A Heuristic Strategy for LLM-based Multi-Agent System Design》https://arxiv.org/pdf/2505.16979 的深度解读和实践验证

文章来自于“AI修猫Prompt”,作者“AI修猫Prompt”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0