没想到啊,最新SOTA的开源大模型……

来自一个送外卖(Waimai)的——有两个AI,确实不一样。

这个最新开源模型叫:Longcat-Flash-Chat,美团第一个开源大模型,发布即开源,已经在海内外的技术圈子里火爆热议了。

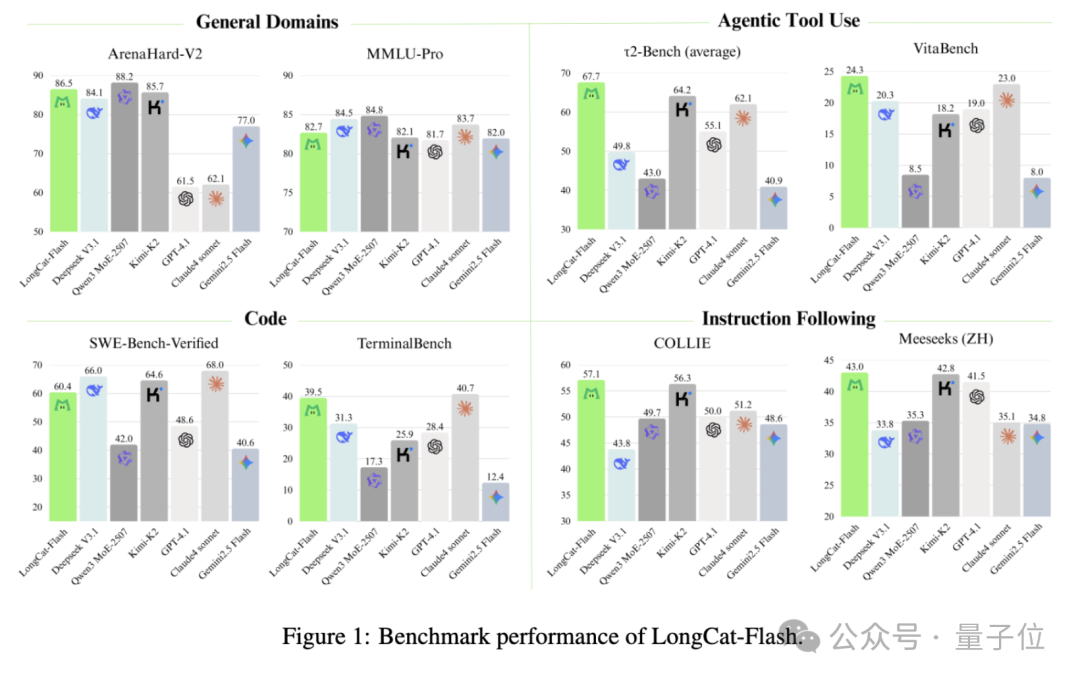

一方面是因为成绩亮眼:

它在部分benchmark上,比如Agent工具调用、指令遵循的表现超过DeepSeek-V3.1、Qwen3 MoE-2507,甚至比闭源的Claude4 Sonnet还要好。

编程能力也值得关注,在TerminalBench上,和公认的“编程之王”Claude4 Sonnet不相上下。

比如非常流行的小球氛围编程测试,LongCat编写的程序,运行起来效果是这样的:

另一方面是技术报告中透露出不少美团对于大模型的理解,包括DSMoE、MLA、动态计算、Infra等等。

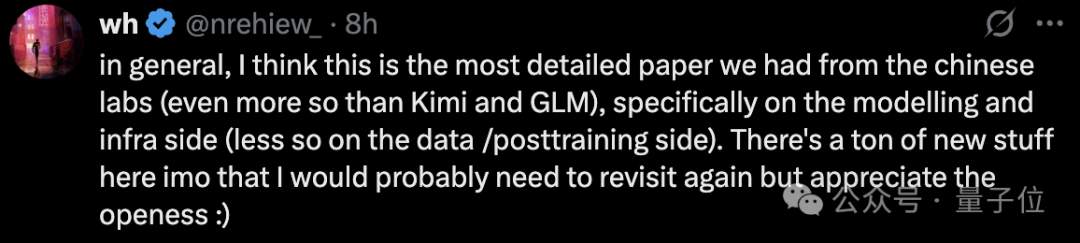

我觉得这是中国大模型里最讲得详细的论文了,甚至超过Kimi、GLM,特别是在建模和infra方面。

要知道,这可是一家“外卖公司”啊(手动狗头),做的模型都比Meta好了。

而且不光是模型性能好,技术报告里还介绍了一系列新发现,比如:

以及无论是在总参数量还是激活参数上,Longcat-Flash-Chat都比DeepSeek-V3.1和Kimi-K2更少。

具体来看——

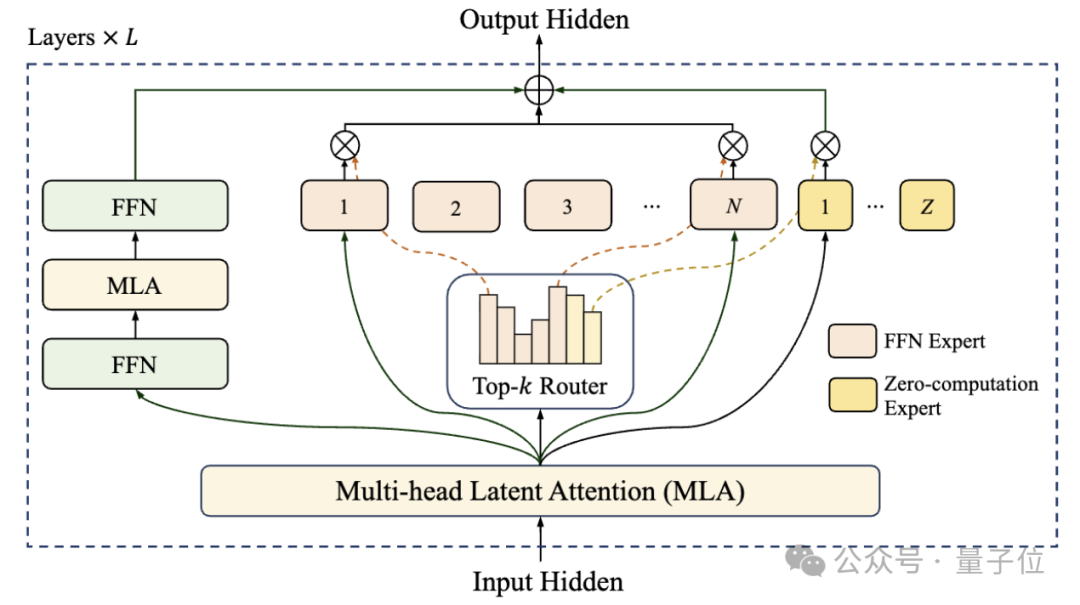

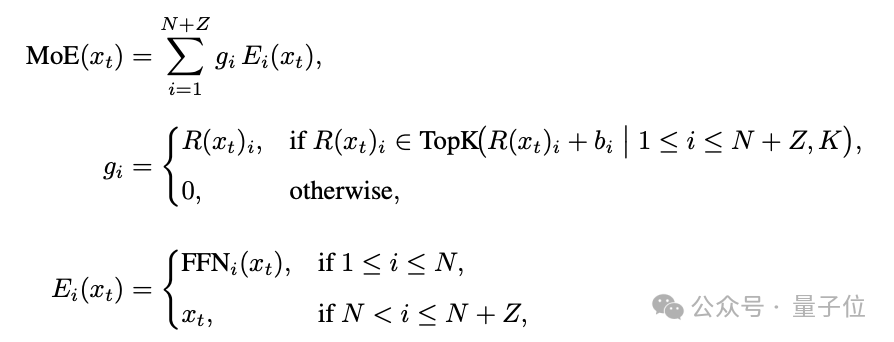

此次开源的Longcat-Flash-Chat是一个560B的MoE模型,整体架构采用“零计算专家”(Zero-computation Experts)与Shortcut-connected MoE双重设计。

它通过根据上下文重要性为每个token动态激活18.6B–31.3B参数,并让前一块密集FFN与当前MoE的通信阶段并行执行,大幅提升训练与推理吞吐。

相比于同为MoE架构的DeepSeek-V3.1(671B/A37B)和Kimi-K2(1T/A32B),Longcat-Flash-Chat都拥有相对更少的总参数量和激活参数量。

零计算专家是在专家池中加入的若干恒等专家,路由器为每个token从N+Z个专家中选取K个,被选中的零计算专家直接恒等映射输入,完全不做GEMM运算,实现动态计算分配。

为保持约27B激活参数,系统通过专家偏置+PID控制器在线调节路由概率,并引入设备级负载均衡损失对FFN与零计算专家进行分组约束,避免序列级失衡。

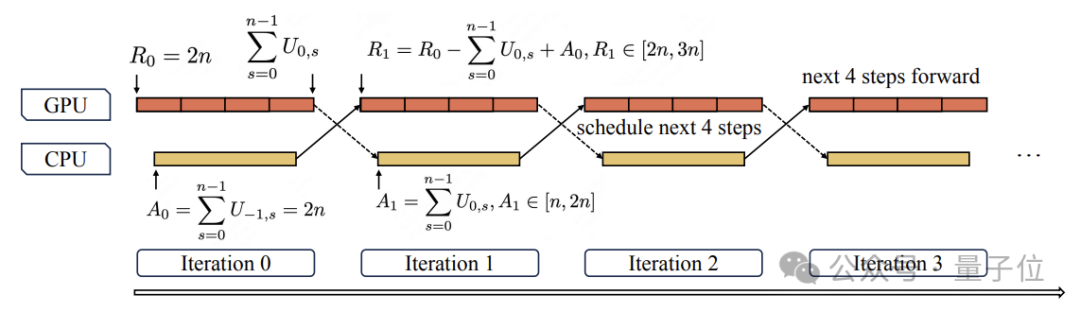

Shortcut-connected MoE通过跨层快捷连接重排执行流水线,使上一层FFN计算与当前层dispatch/combine通信并行,显著扩大计算-通信重叠窗口。

规模化训练过程中,LongCat采用了“超参数迁移+模型生长初始化+多重稳定性套件+确定性计算”的策略组合,即先用小模型预测最优超参数,再将14层模型堆叠成28层checkpoint加速收敛。

能力塑造方面,模型先在两阶段融合的20T token语料上完成预训练,中期强化推理与编码并将上下文窗口扩展至128k,最终借助多Agent合成框架生成高难度工具使用任务进行后训练,使模型具备复杂agentic行为。

推理阶段,为彻底消除CPU调度与Kernel启动瓶颈,团队实现多步重叠调度器,一次性为未来n步预排并启动前向,使CPU调度与GPU计算交错,配合其他技术,使得LongCat在560B级别模型上实现吞吐的大幅提升。

最终,LongCat-Flash在多类权威基准中处于第一梯队,在非思考大模型中与DeepSeek-V3.1等模型相当甚至更优。

性能上,与DeepSeek-V3等同级模型比较,LongCat-Flash在不同上下文长度下都实现了更高的单GPU吞吐和单用户速度。

560B参数的LongCat-Flash在上万个加速卡上完成超过20Ttoken预训练仅用30天,训练期间可用率98.48%,单张H800GPU生成速度超过100 tokens/s,成本约0.7美元/百万输出token。

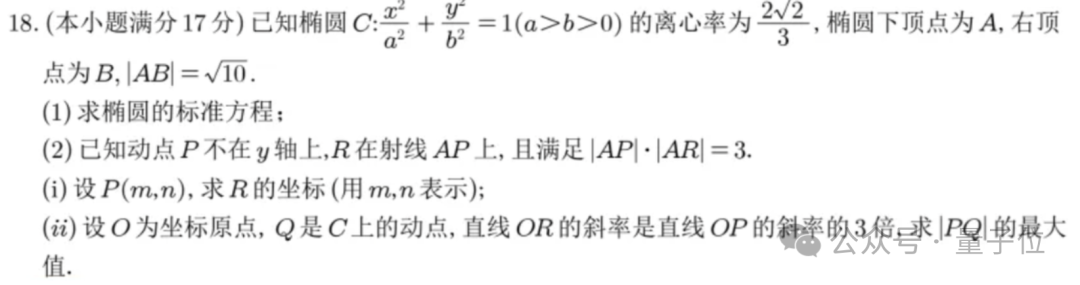

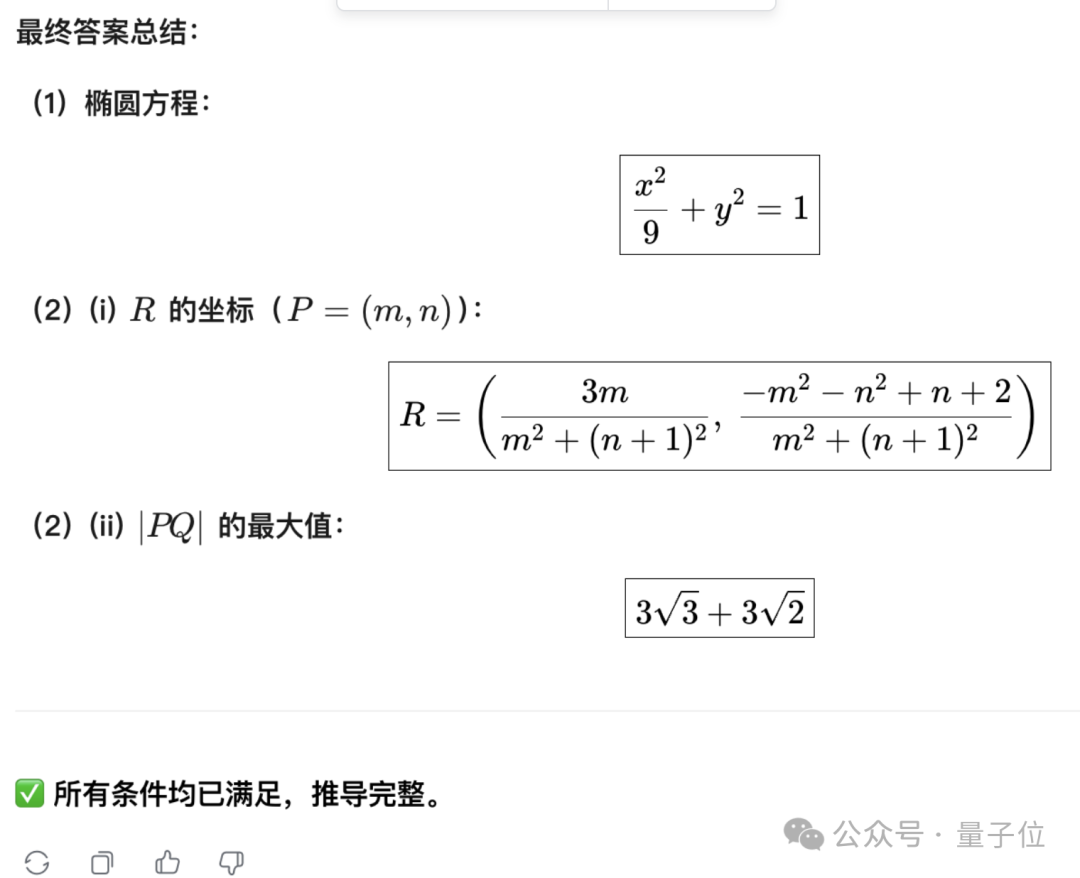

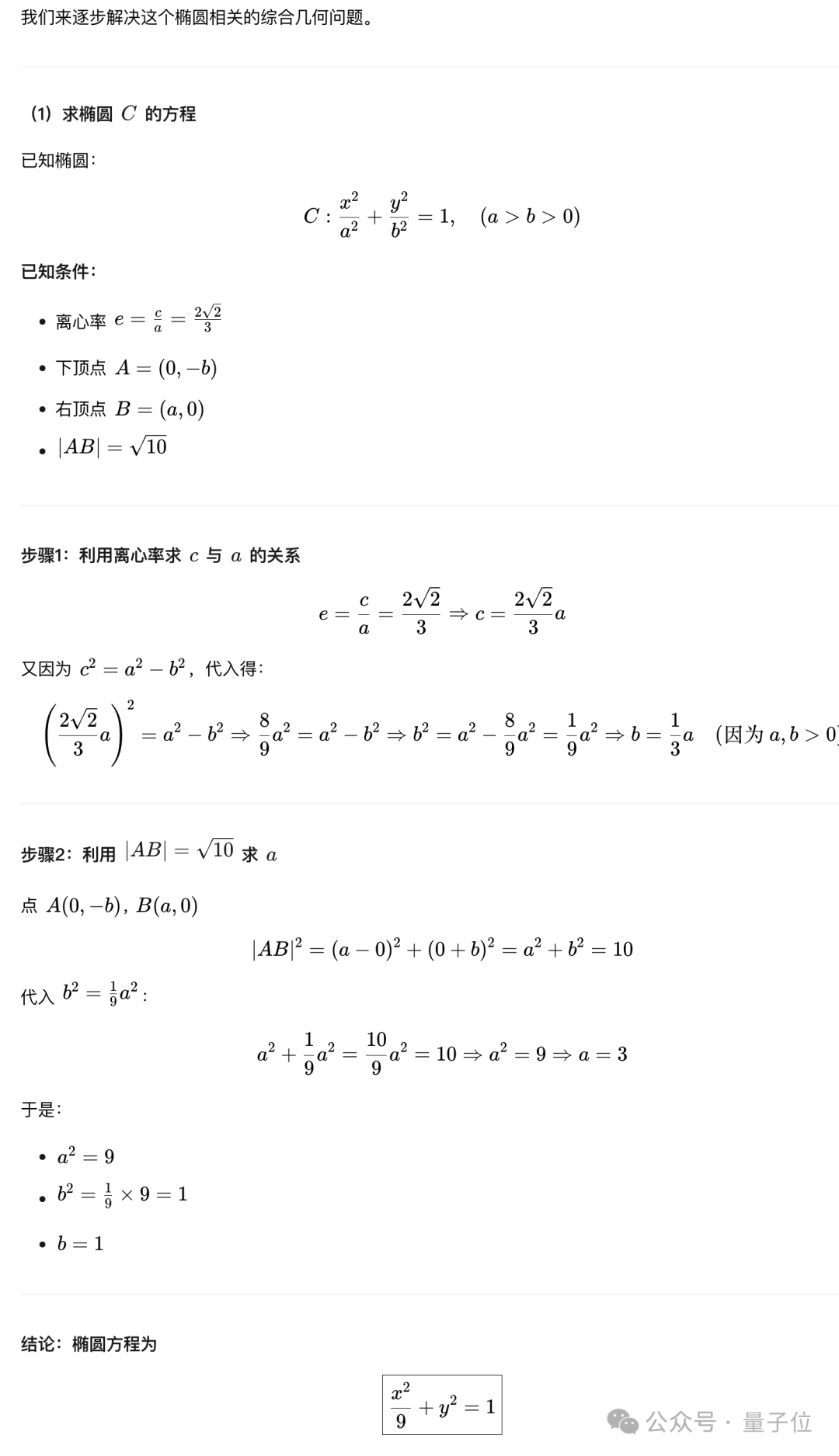

那么接下来,就来看看LongCat的真实表现,我们跳过简单的基础问答,直接上数学题。

这道题出自今年的全国一卷。这里题目是以文本形式输入给模型的,且公式转换成了LaTeX格式。

先看结果,LongCat的最终答案全部正确:

接下来检查一下具体过程。

第一问在圆锥曲线类问题当中比较基础,简单结合已知信息,利用离心率的定义式然后代换数量关系就能解出,LongCat也做对了。

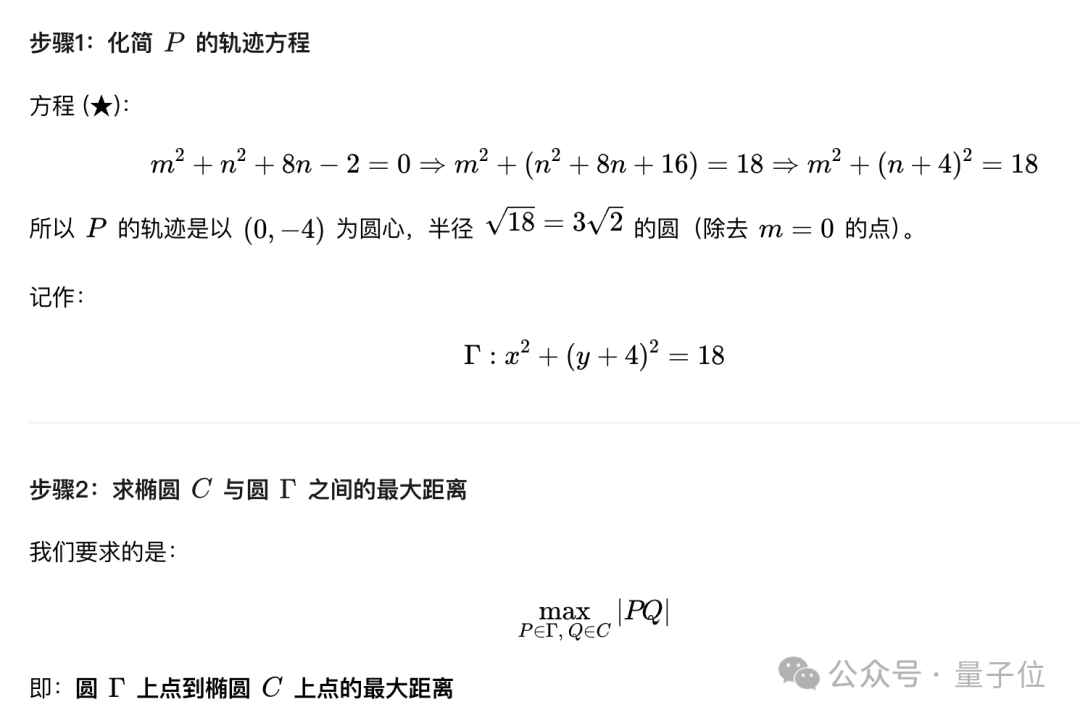

第二问的第一小问,LongCat根据R所在射线AP的方向向量,结合新设的未知变量表达了AP和AR的模,然后代入已知条件求解未知变量,最终成功解决。

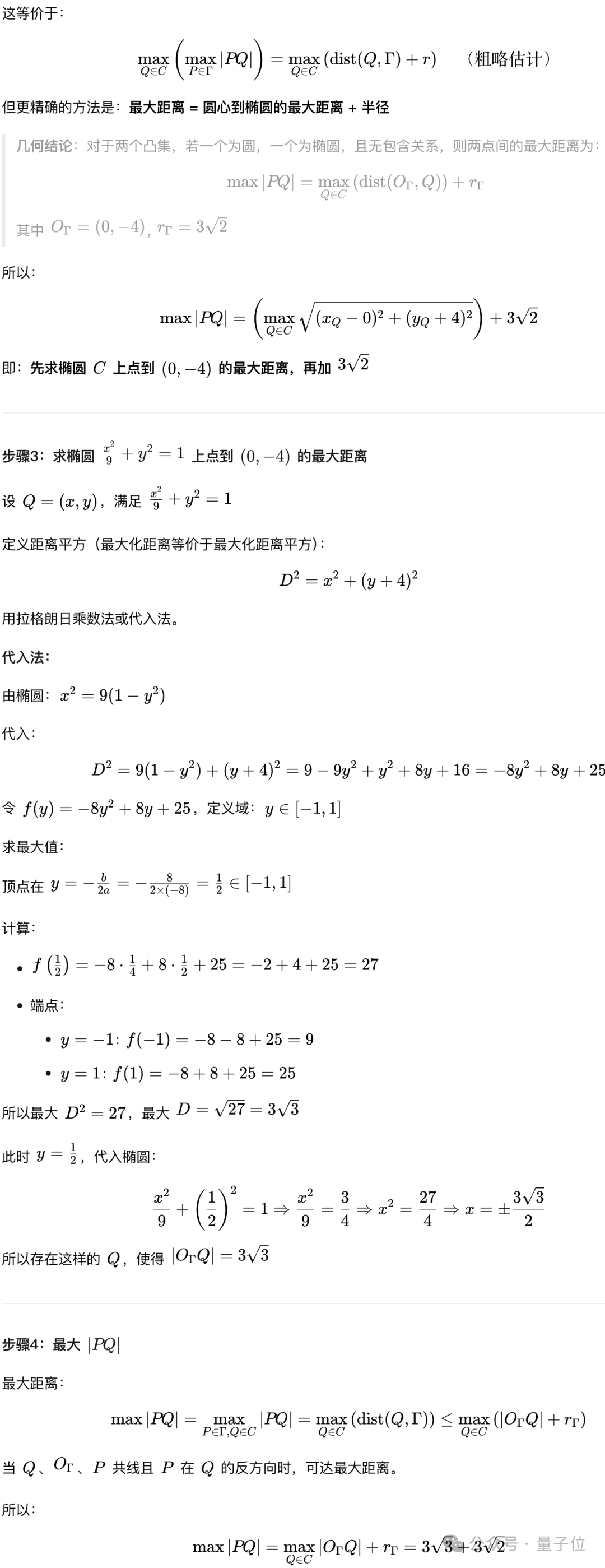

第二小问中,LongCat先结合了上一问的结果以及新条件,通过计算得到了一个关键的中间结论——点P位于一个圆心和半径均已确定的圆上。

如果想象不到,这里有一个简单图示。

利用该结论,LongCat对最大距离进行了拆解,并通过代入等方法,最终计算出了正确结果。

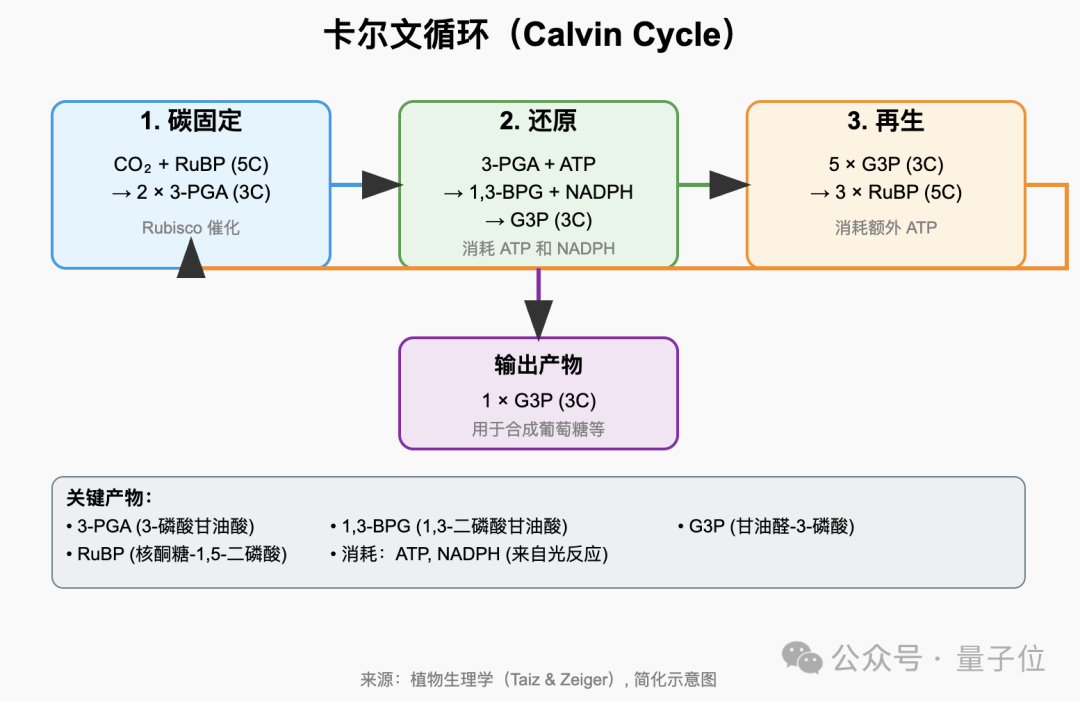

接下来是一项综合能力测试,绘制生物学当中光合作用当中卡尔文循环的SVG示意图,SVG是一种用代码表示的矢量图形。

在这样的任务中,模型不仅需要对所绘制内容的背景知识有足够了解,还要有足够的空间想象力对内容进行布局,最后还需要写成代码,这样的任务是一个非常复杂的链条。

言归正传,我们对LongCat给出的SVG代码进行了可视化,总的来说,LongCat比较顺利地完成了图示的绘制。

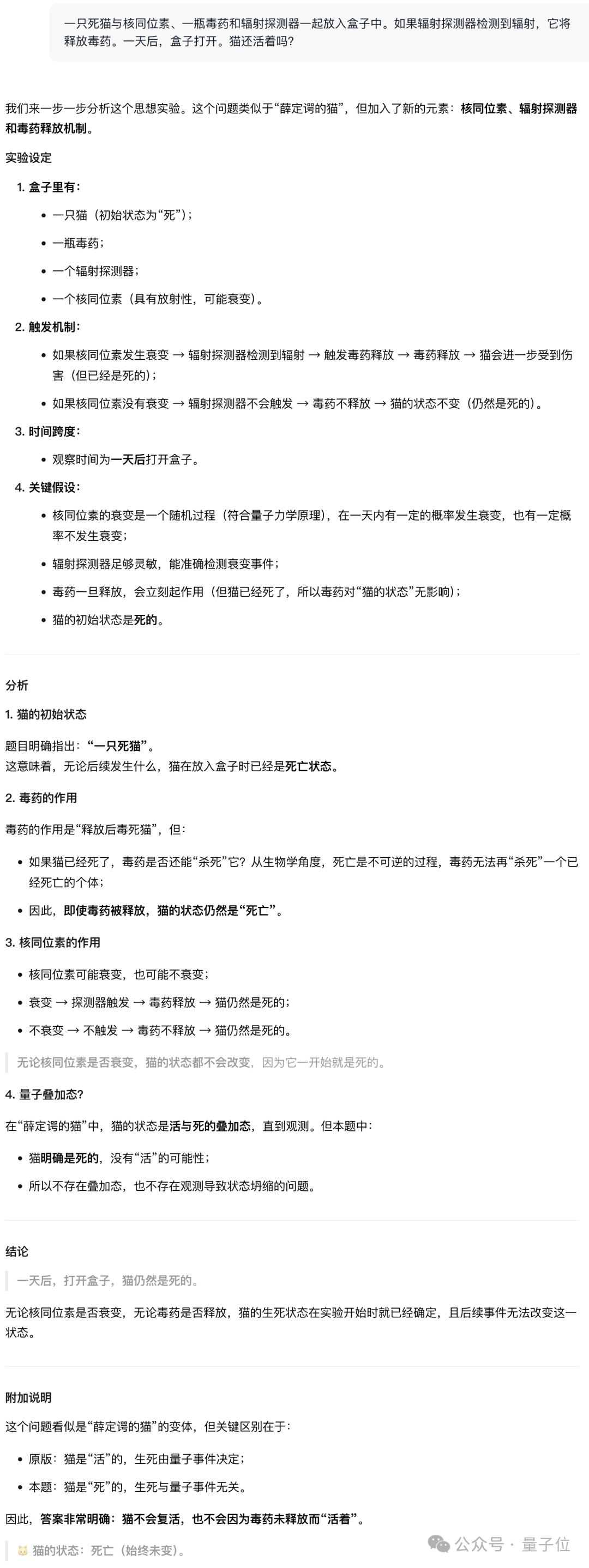

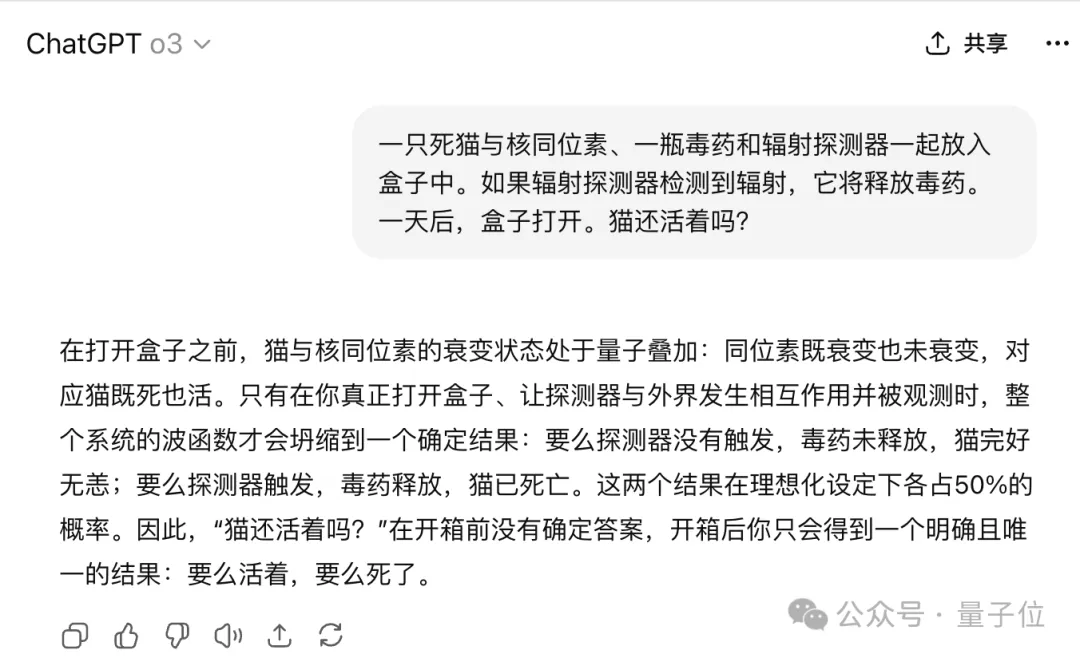

最后是一道迷惑性问题,题目出自GitHub上一个名为Misguided Attention的Benchmark。

其中包含了很多经典谜题……的改编版本,考验的就是大模型能不能做到不被表象迷惑。

比如物理学当中的名场面——薛定谔的猫,在这套基准当中,这只猫的“猫设”被改成了一只死去的猫。

一只死猫与核同位素、一瓶毒药和辐射探测器一起放入盒子中。如果辐射探测器检测到辐射,它将释放毒药。一天后,盒子打开。猫还活着吗?

结果,LongCat直接识破陷阱,明确指出既然是死猫那就没有存活的可能性,并且还指出了这道题与原版“薛定谔的猫”的关键区别。

而o3就没有认真读题,还是按照传统的薛定谔的猫那一套进行的回答。

这次引发海外热议的还有一个原因在于美团给他们带来的反差感。

很多人简单粗暴把美团理解为一家外卖公司。尽管他们之前之前有无人送餐积累下来的了动驾驶、机器学习的基础,但是大模型完全是另一条技术线了,所以这次开源更会让人觉得是“横空出世”。

不过梳理美团在大模型浪潮后的AI动向,这次模型开源也就不那么意外了。

2023年,王慧文振臂一呼自带5000万美元成立光年之外,并招揽一众AI领域顶级人才团队加盟。后续由于王慧文个人健康原因,好兄弟王兴兜底,美团于是接手光年之外,现有团队将继续研发大模型。

同年,由美团内部独立AI团队GN06开发的AI情感陪伴产品Wow上线,这也是美团发布的第一个独立AI应用。

2024年4月,病休的王慧文以顾问身份回归美团,11月正式领导GN06团队。

GN06在美团的定位是一个相对独立的AI团队、不隶属于任何事业群,专注于探索主营业务之外的创新AI应用。

2024年他们还推出了一个AI图像生成应用“妙刷”。

在2024年6月,GN06的招聘需求明显增加,范围覆盖前端、客户端、后端、产品、运营、商分等。

2024财年业绩发布会上,美团还正式明确了“主动进攻”的AI策略。

美团CEO王兴首次阐述了公司的AI战略布局,主要通过三层架构推动技术落地:

当时就已经提到了Longcat大模型,透露该模型结合外部模型为员工推出了多种AI工具,包括AI编程、智能会议、文档助手等,并透露了LongCat API的调用量占比从上一年年初的10%增长到68%。从这个信息推断,Longcat在至少在2024年初就已经可以落地应用。

另外在研发投入上,2024年美团投入211亿搞研发,规模仅次于华为、腾讯和阿里巴巴。过去5年研发投入突破1000亿元。

产品结合方面,美团测试推出了问小袋、米鲁等AI智能助手,用于餐饮推荐、问答交互等。

在这种战略下,2025年美团在AI方向的动作更加明显起来。

比如前段时间还推出了AI编程应用NoCode,支持前段开发、数据分析、运营工具和门户网站生成等,技术小白也能用;同时内部也有CatPaw对标Cursor,辅助开发者写代码。

总体来看,以美团的研发储备,开源一个大语言模型并不意外。

不过也不同于AI公司,美团的AI布局更多以业务场景驱动为核心,注重在实际应用中的落地效果。

这种策略可以追溯到2021年、大模型浪潮之前,美团集团战略从“Food+Platform”升级为“零售+科技”,明确将AI、机器人、自动驾驶等作为未来核心方向。

比如在更加早期的具身智能领域,美团已多次出手,投资了宇树、星海图、银河通用、它石智航等头部梯队公司。

你用来拼好饭的美团,确实不是单纯送外卖的美团。

虽然外卖大战依然火热,但用AI的视角审视美团,也是时候了。

试用地址:https://longcat.chat

huggingface:https://huggingface.co/meituan-longcat/LongCat-Flash-Chat

github:https://github.com/meituan-longcat/LongCat-Flash-Chat

x/twitter:https://x.com/Meituan_LongCat/status/1961827385667690965

文章来自于微信公众号“量子位”,作者是“克雷西,明敏”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI