FLUX 、Qwen-Image 等多模态生成模型的推理速度一直是工业级多模态模型落地的痛点。传统的特征缓存(Feature Caching)方案在追求高倍率加速时,常因瞬时速度的剧烈波动导致轨迹漂移。

针对这一痛点,中国联通数据科学与人工智能研究院与南京大学研究团队,在此前工作 LeMiCa(NeurIPS 2025 Spotlight)的基础上继续深耕,推出了进阶加速框架 MeanCache。

该工作不仅承袭了团队在扩散模型加速领域的深厚积淀,更在技术上实现了跨越:受到 MeanFlow 启发,MeanCache 首次将 “平均速度” 视角引入缓存推理,通过 JVP 修正精准校正了生成轨迹,实现了 4x 以上的推理提速。该成果已入选人工智能顶会 ICLR 2026,目前,论文、代码均已开源。

MeanCache 的核心贡献在于将缓存加速从 “瞬时速度” 转向了 “平均速度”,主要包含以下两个核心技术点:

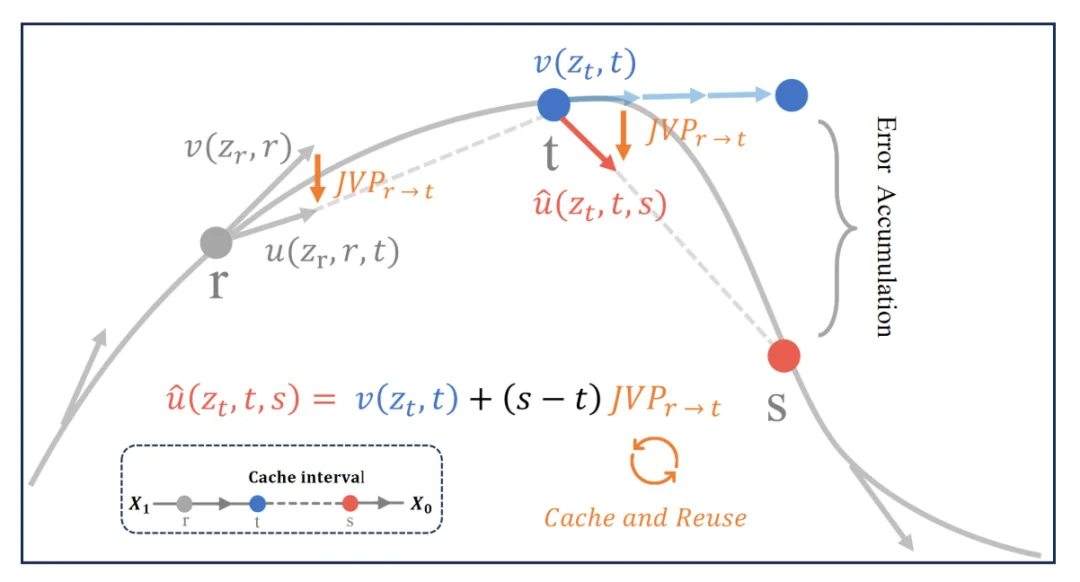

JVP 驱动的平均速度

为了在不增加推理开销的前提下获取平均速度,MeanCache 引入了雅可比 - 向量积(JVP)作为计算桥梁。基于推导出的起点锚定恒等式,MeanCache 利用前一时间步已缓存的 JVP 信息来修正当前的瞬时速度 :

该建模方式将缓存视角从单一的 “点” 扩展到了 “区间”,通过提供更稳定的引导信号,有效地校正了高倍率加速下的轨迹偏离。

轨迹稳定调度策略

“什么时候该缓存?” 以往的方法多依赖固定步长或手动阈值。MeanCache 将推理过程建模为一个多重图(Multigraph)寻优问题。

它将每个时间步视为节点,将预测均值速度与真实值之间的稳定性偏差定义为边权:

节点和边组成多重图,然后再通过峰值抑制最短路径(Peak-Suppressed Shortest Path)算法,在给定的计算预算下,计算规则下最优的缓存策略:

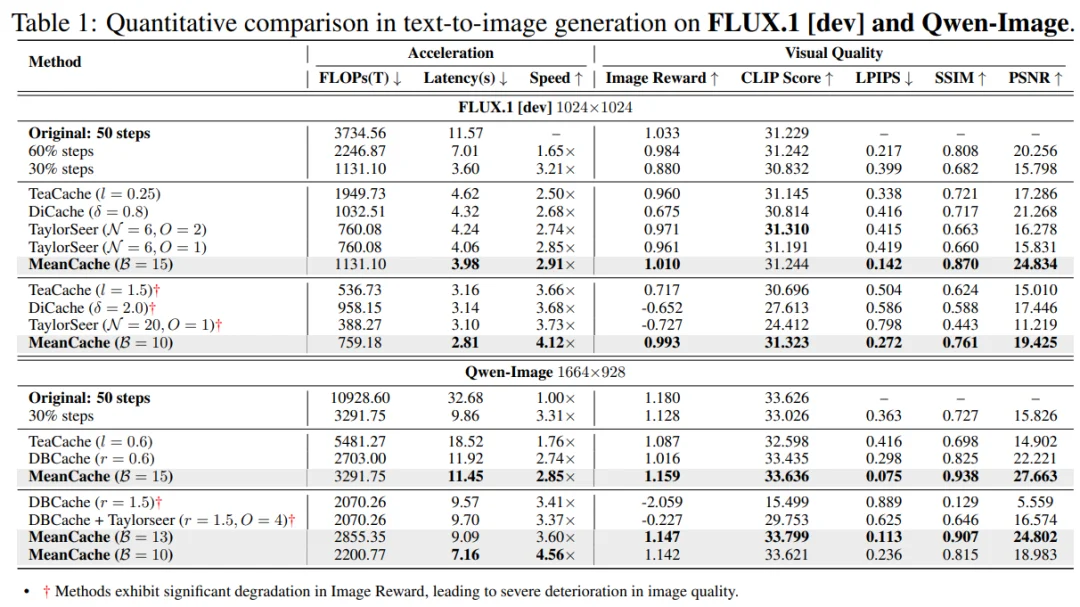

文生图

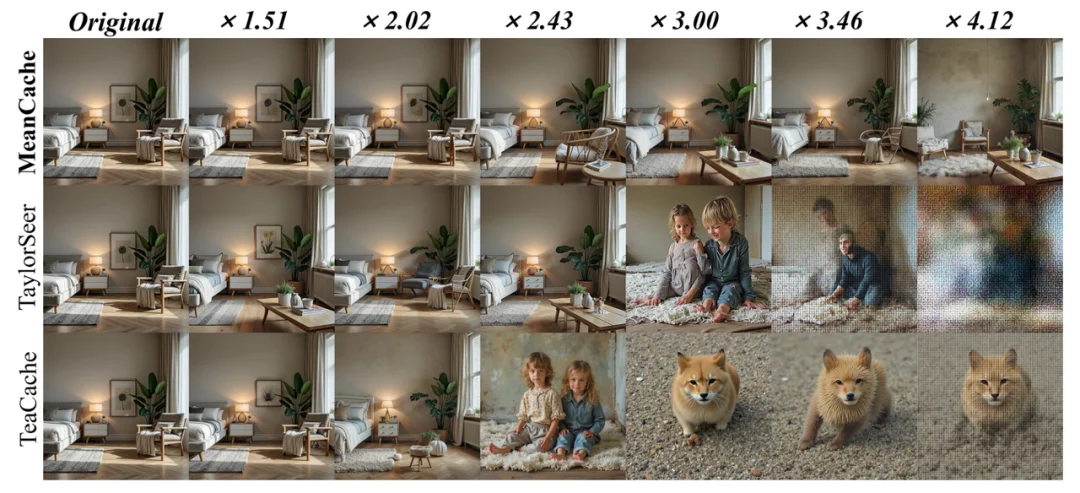

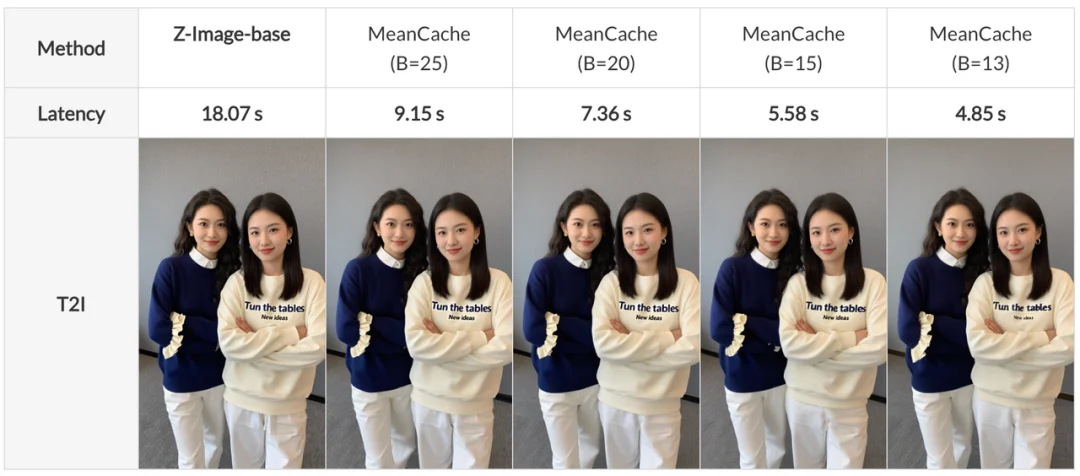

在商业级文生图模型 Qwen-Image 和 FLUX.1 [dev] 分别实现最高 4x 加速,在 Image Reward 和感知指标上取得了 SOTA 的表现。

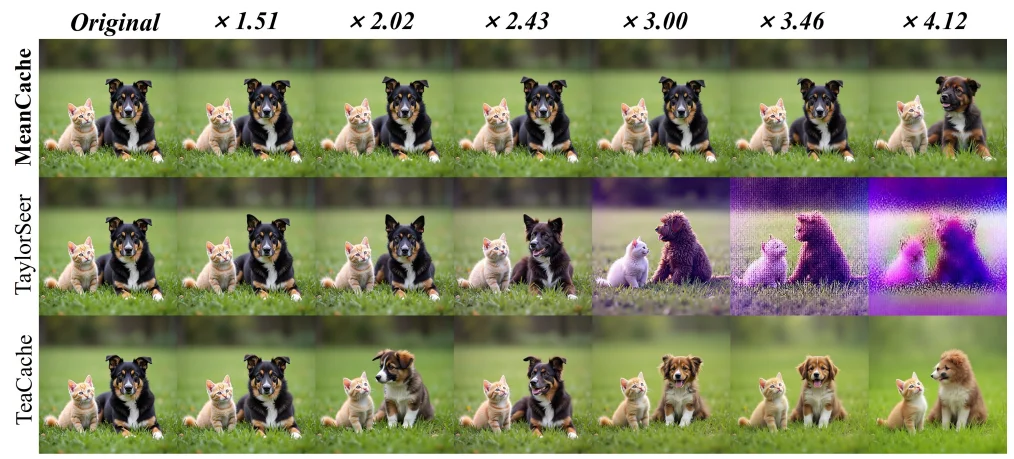

从视觉效果上看,随着加速比的增大,MeanCache 生成的图片在内容一致性方面表现更好。

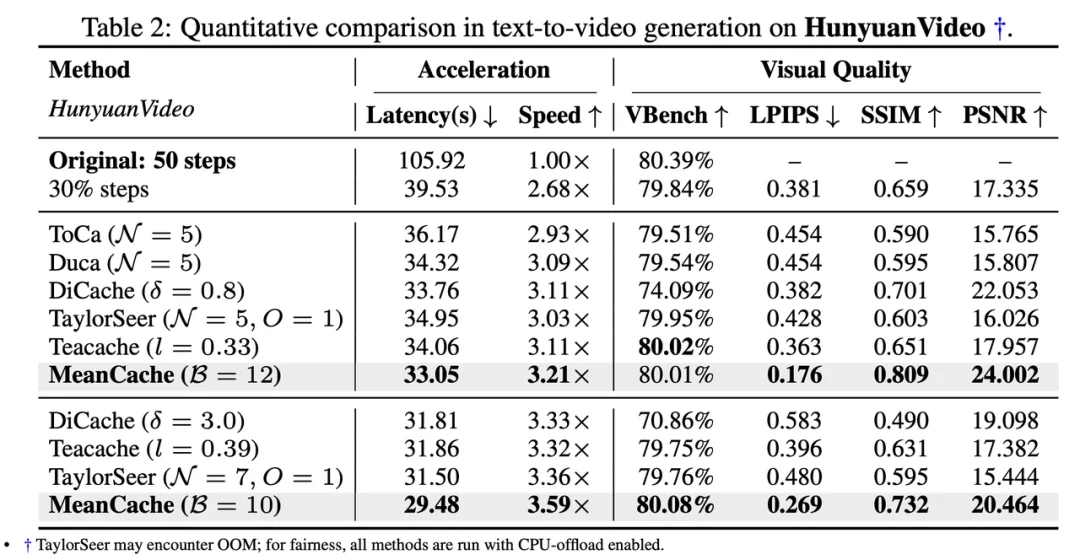

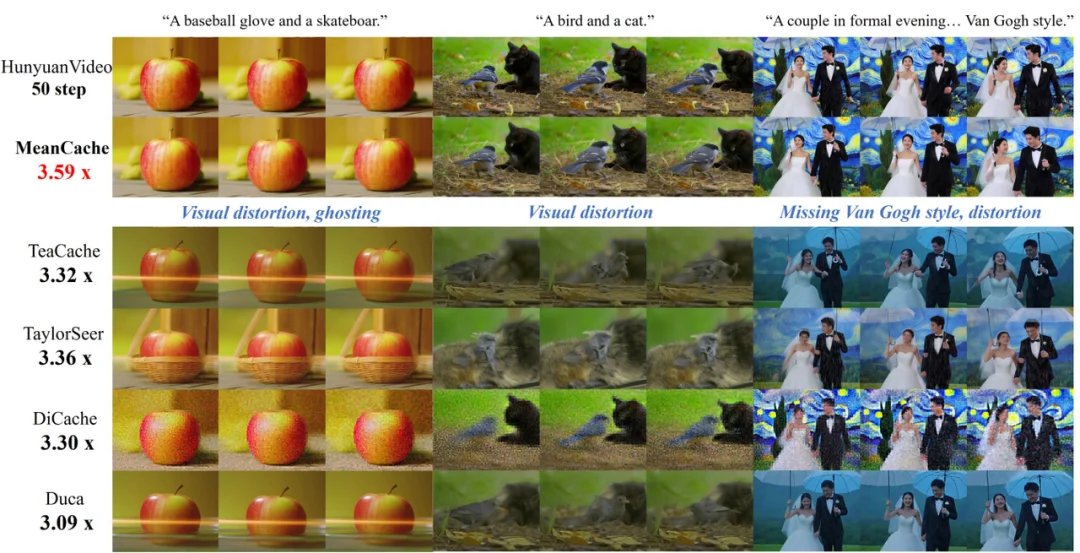

文生视频

在视频生成模型 HunyuanVideo 上也实现了 3.6x 加速和 SOTA 的指标提升。

在对视频的定性分析上,MeanCache 也表现出更好的加速效果,不论是画质还是内容一致性方面。

语义一致性:更进一步,针对 rare-word(如下图 "Peristeronic")的高难度生僻 Prompt 的测试下,MeanCache 展现了更强的语义鲁棒性。

同时,MeanCache 已支持最新的阿里通义 Z-Image 和 Qwen-Image-2512 文生图模型,并获得了 Z-Image 团队的官方主页推荐,社区已支持 ComfyUI。

MeanCache 作为一种轻量化、免训练的 Flow Matching 加速框架,创新性地提出了 “平均速度缓存” 与 “轨迹稳定性调度” 方案。该方案在确保图像高保真度与内容一致性的基础上,显著提升了大模型的推理效率。 联通元景大模型团队将以此为基石,持续深耕模型推理加速及复杂场景生成领域。我们致力于为业界贡献更多元化的技术视角,进一步降低工业级生成模型的使用门槛与算力成本。

文章来自于"机器之心",作者 "高焕霖"。

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】kimi-free-api是一个提供长文本大模型逆向API的开渔免费技术。它支持高速流式输出、智能体对话、联网搜索、长文档解读、图像OCR、多轮对话,零配置部署,多路token支持,自动清理会话痕迹等原大模型支持的相关功能。

项目地址:https://github.com/LLM-Red-Team/kimi-free-api?tab=readme-ov-file

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0