免费100万亿Token,开源模型新王登场。

智东西4月28日报道,刚刚,小米开源罗福莉带队研发的MiMo-V2.5系列模型,采用MIT协议,允许商用推理部署与二次训练,无需额外授权。

▲MiMo-V2.5-Pro在Hugging Face的开源页面截图

此前,该系列模型于4月23日开启公测,包括MiMo-V2.5-Pro、MiMo-V2.5两款模型。模型具备更强Agent能力,支持100万上下文,且Token效率大幅提升。

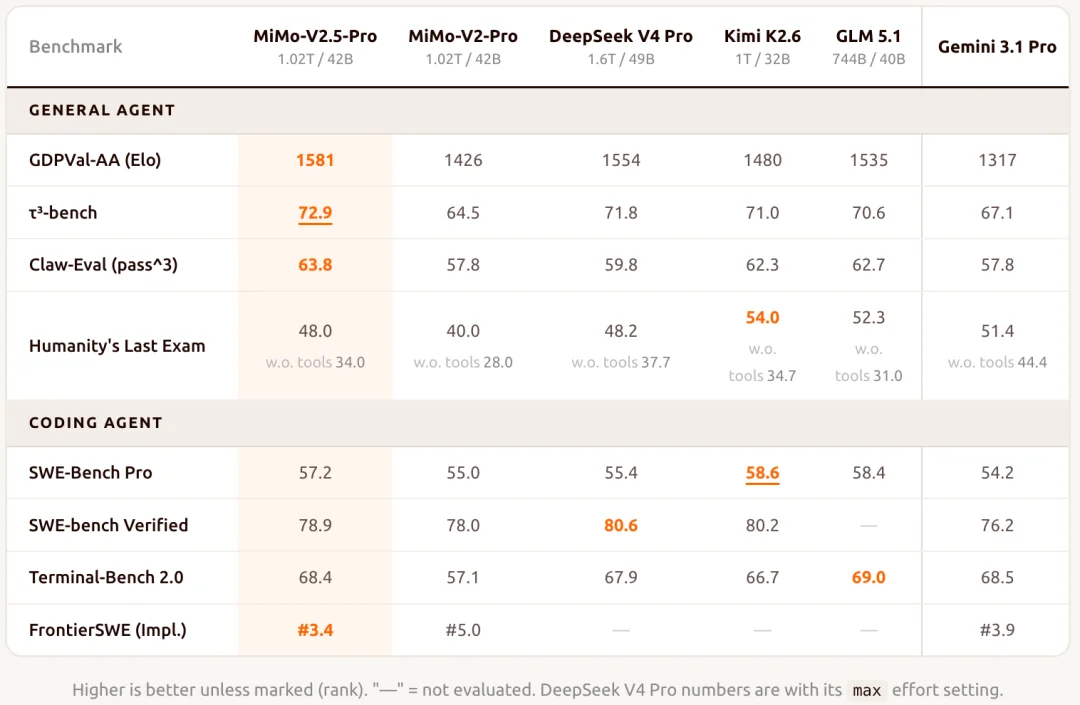

MiMo-V2.5-Pro的完整基准测试结果今日公布,小米称其在GDPVal-AA(Elo)、Claw-Eval(pass^3)等多项测评中超过了最新开源的DeepSeek-V4-Pro模型,也超过了发布不久的Kimi K2.6等主流闭源模型,实现总体最佳。

▲MiMo-V2.5-Pro的最新测评成绩

开源首日,MiMo-V2.5-Pro宣布已完成与阿里平头哥、亚马逊云科技、AMD、百度昆仑芯、燧原科技、沐曦、天数智芯多个芯片厂商的接入适配。MiMo-V2.5系列模型同步完成SGLang和vLLM主流推理框架的Day 0适配。

与此同时,小米还推出百万亿Token创造者激励计划,计划30天内免费发放总计100万亿Token权益;推出Agent生态共建计划,目前已与OpenCode、Hermes Agent、KiloCode等Agent框架厂商展开合作。

模型权重合集:

https://huggingface.co/collections/XiaomiMiMo/mimo-v25

更多细节参考模型Blog:

https://mimo.xiaomi.com/index#blog

百万亿Token计划申请网址:

https://100t.xiaomimimo.com/

模型技术细节公布

测评超越DeepSeek-V4

由小米最新公开的模型卡可知,小米迄今为止最强模型MiMo-V2.5-Pro是一款拥有1.02万亿(1.02T)个参数的混合专家模型,其中420亿(42B)个激活参数,基于混合注意力架构,相比前代模型在通用智能能力、复杂软件工程和长时域任务处理方面均实现了显著提升。

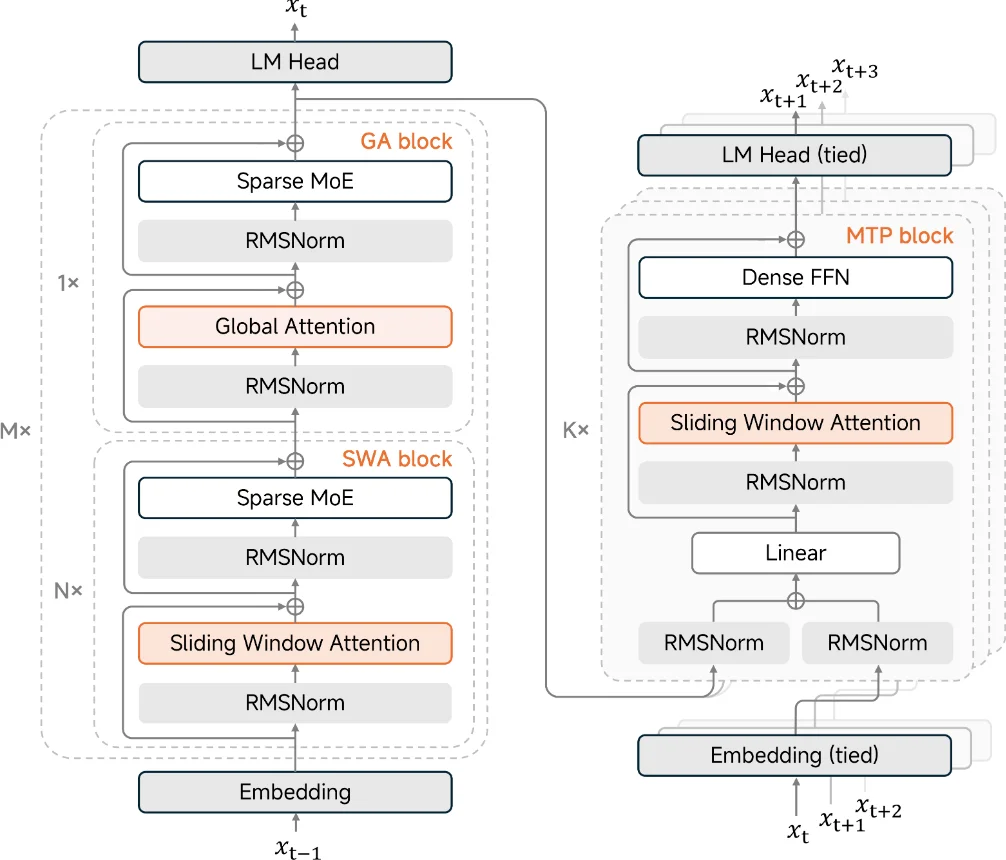

MiMo-V2.5-Pro继承了MiMo-V2-Flash的混合注意力机制和多标记预测(MTP)设计。局部滑动窗口注意力(SWA)和全局注意力(GA)以6:1的比例交错使用,窗口大小为128个Token,在长上下文情况下,通过可学习的注意力池偏置,将键值缓存存储空间减少了近7倍,同时保持了性能。一个轻量级的MTP模块,采用密集前馈神经网络(FFN),原生集成用于训练和推理,输出吞吐量大约提升了三倍,并加速了强化学习(RL)的部署。

▲MiMo-V2.5-Pro的模型架构及训练过程

该模型预训练使用27万亿(27T)个Token,采用FP8混合精度,原生序列长度为32K,上下文扩展至1M个Token。后训练遵循MiMo-V2-Flash中引入的三阶段范式:1、监督式微调,在精心挑选的数据对上建立基础的指令跟踪;2、领域专精训练,其中不同的教师模型分别通过针对特定领域的强化学习进行优化,涵盖数学、安全、智能工具使用等领域;3、多教师策略蒸馏(MOPD),其中单个学生模型在每位专精教师的Token级指导下,从自身的展开中学习策略,并将所有教师的能力融合到一个统一的模型中。

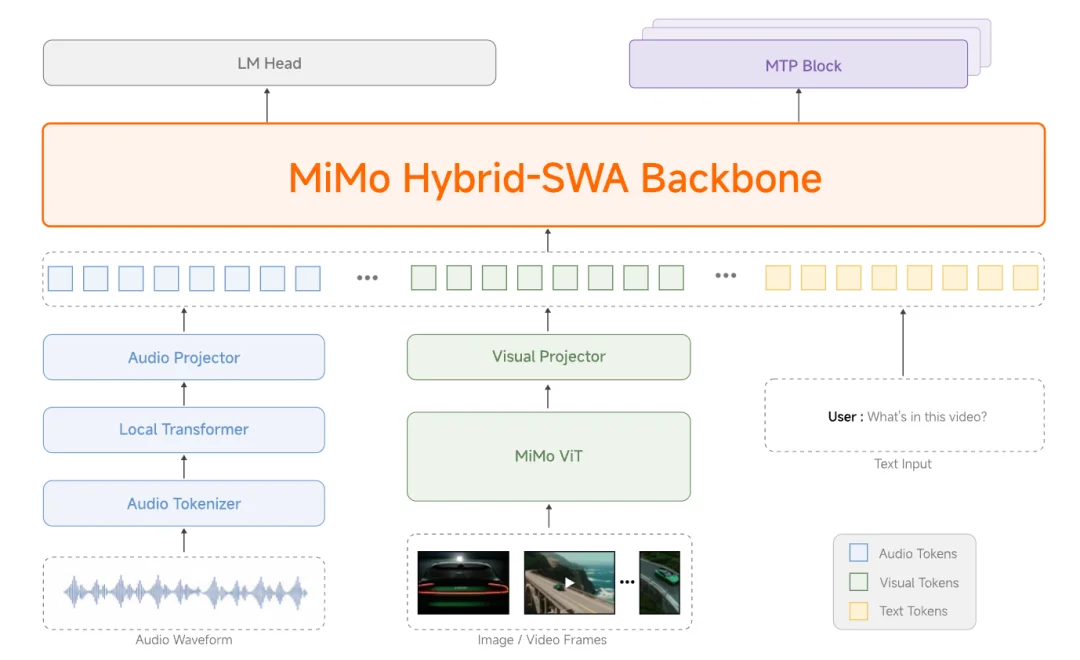

再来看看MiMo-V2.5,这是一个3100亿(310B)参数的稀疏MoE模型,拥有150亿(15B)激活参数,在48万亿(48T)个Token上进行训练。它的语言主干框架继承了MiMo-V2-Flash的混合滑动窗口注意力机制,并搭载自研预训练视觉、音频编码器,两类编码器通过轻量化投影模块完成跨模块融合。

▲MiMo-V2.5架构

训练过程分为五个阶段:1、基于多样化语料开展文本预训练,搭建大语言模型主干网络;2、进行投影层预热训练,实现音视频、视觉投影器与语言模型的对齐融合;3、依托高质量跨模态数据集,开展大规模多模态预训练;4、执行监督微调与智能体后训练,在此过程中将上下文窗口从32K逐步扩容至256K,最终达到100万Token;5、最后是通过强化学习(RL)与多目标偏好蒸馏(MOPD),进一步强化模型的感知、逻辑推理与智能体执行能力。

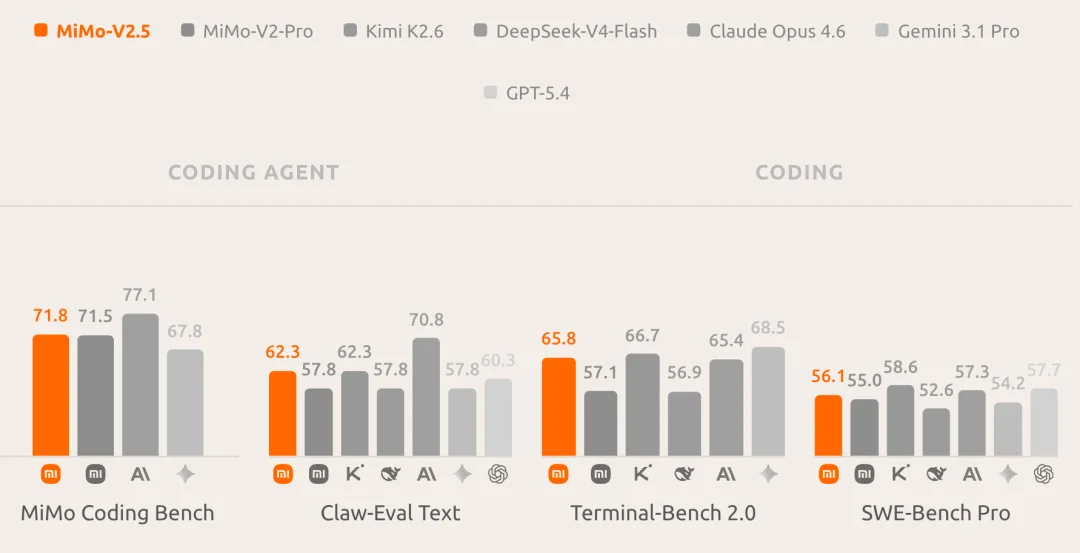

从小米最新公布的测评结果来看,MiMo-V2.5在Claw-Eval Text、Terminal-Bench 2.0、SWE-Bench Pro等多项测评中大幅超越了DeepSeek最新发布的DeepSeek-V4-Flash。

▲MiMo-V2.5最新测评情况

开源首日,完成阿里平头哥沐曦

等7家芯片厂商适配

小米还公布了芯片生态与推理框架最新适配情况,MiMo-V2.5-Pro开源首日完成多个芯片厂商的接入适配:

阿里平头哥:基于真武810E及全栈自研AI软件栈实现深度适配。

亚马逊云科技:基于Trainium2芯片与Neuron SDK+vLLM推理框架完成深度适配,实现开源即全球可用的首日适配。下一代3nm制程Trainium3将进一步释放模型性能。

AMD:依托ROCm开源软件栈提供Day-0适配及全面优化支持。

百度昆仑芯:通过底层算子优化与软硬件协同加速,保障模型稳定高效运行。

燧原科技:基于自研驭算TopsRider软件栈深度优化,在燧原L600上完成全量适配。

沐曦:基于曦云C系列及全栈自研MXMACA软件栈,实现Triton语法到沐曦GPU指令集的端到端原生支持。

天数智芯:实现Day 0级深度适配。

此外,MiMo-V2.5系列模型同步完成SGLang和vLLM主流推理框架的Day 0适配。

免费发放100万亿Token

已与Hermes Agent等合作

与此同时,小米还同步推出MiMo Orbit计划,包含两部分:“百万亿Token创造者激励计划”,与面向Agent框架团队的“Agent生态共建计划”。

在百万亿Token创造者激励计划方面,小米面向全球AI用户免费发放Token,30天内发放总计100万亿Token权益,赠完即止。

该计划采取申请制,通过者最高获得Max档位Token Plan,包含16亿Credits,价值659元。活动时间:北京时间2026年4月28日00:00至5月28日00:00。

Agent生态共建计划方面,小米面向全球Agent框架团队提供专项支持,为框架提供MiMo Token限免支持,同时参与和赞助框架平台的AI Hackathon等共创活动。

其目前已与OpenCode、Hermes Agent、KiloCode等Agent框架厂商展开深度合作。

结语:多款国产开源模型“亮剑”交锋

近期,大模型行业开源力度持续加码,模型与国产及国际芯片的“Day 0”适配已从亮点变为刚需,推理效率和部署成本成为下一阶段竞争的核心。同时,百亿级Token免费激励与Agent框架生态共建,反映出行业正从“拼参数”转向“拼应用”。

值得关注的是,小米MiMo-V2.5-Pro在多项基准评测中直接超越DeepSeek最新开源的DeepSeek-V4-Pro模型,可谓与DeepSeek在开源赛道发起“亮剑”交锋,有望倒逼行业更快降低推理成本、提升Agent真实任务完成率。

文章来自于微信公众号 "智东西",作者 "智东西"

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner