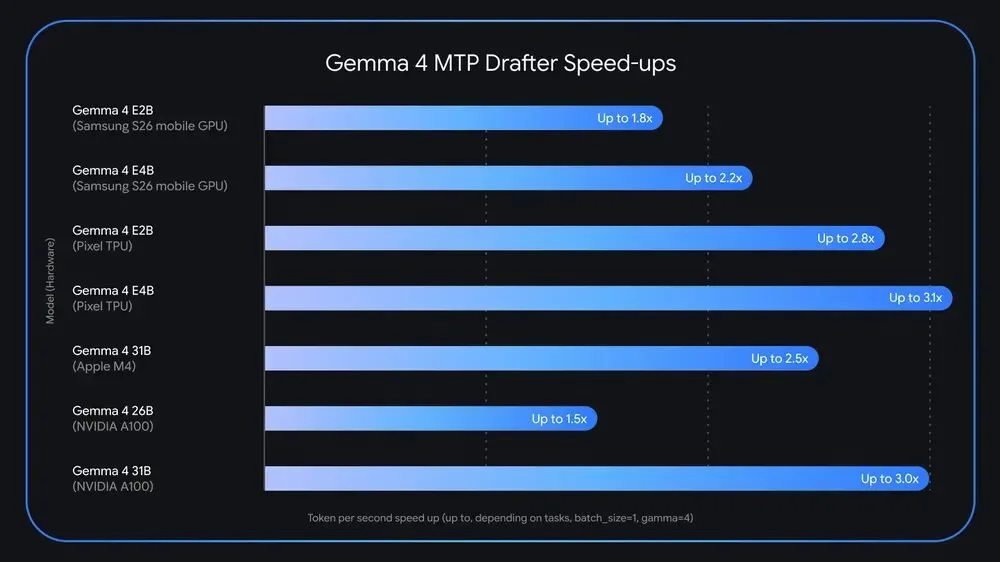

谷歌刚刚给Gemma 4家族更新了一项关键能力:Multi-Token Prediction(MTP)推测解码架构,推理速度最高提升3倍,输出质量不变。

就在几周前,Gemma 4刚刚发布,首批下载量已超6000万次。这次更新直接瞄准了开发者最关心的痛点——速度。

根本原因在于内存带宽瓶颈。

标准大模型每次只能生成一个token,处理器需要把数十亿参数从显存搬到计算单元,才能完成这一个token的预测。不管是预测简单词语还是解复杂逻辑,每一步消耗的算力是一样的,计算资源大量闲置,延迟自然居高不下,在消费级硬件上尤为明显。

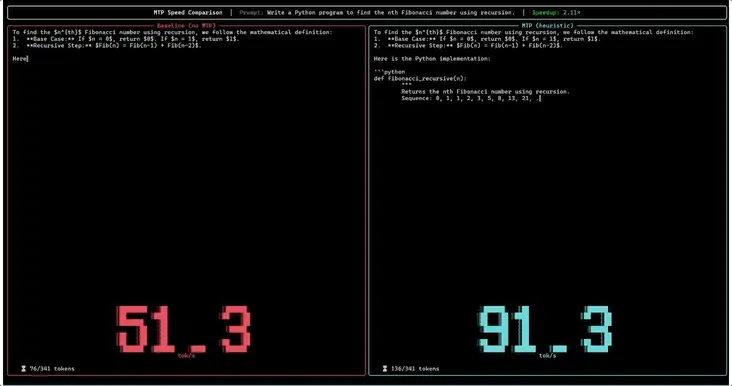

核心思路是:用一个轻量级的草稿模型,提前预测多个token,再让大模型并行验证。

具体流程是:轻量草稿模型(drafter)利用闲置算力,在大模型处理一个token的时间里,连续预测出多个候选token;大模型随后对这批候选token做一次并行验证,如果全部认可,就直接接受整个序列,并额外生成一个新token。

结果是:原本生成一个token的时间,现在可以输出整个草稿序列加一个额外token。

这一技术最初来自谷歌研究人员发表的论文 Fast Inference from Transformers via Speculative Decoding。

对于部署场景,MTP drafters带来的具体改变包括:

近实时响应:实时对话、语音应用、多步骤智能体工作流的延迟大幅降低。

本地开发提速:26B MoE和31B Dense模型可以在个人电脑和消费级GPU上跑出更快速度,离线编码和复杂工作流不再卡顿。

边缘设备增强:E2B和E4B模型在边缘设备上的输出速度提升,同时降低电池消耗。

质量零损失:大模型保留最终验证权,推理精度和输出质量与原版完全一致。

为了让草稿模型跑得更快、预测更准,谷歌做了几项架构层面的优化。

草稿模型直接复用目标大模型的激活值,并共享其KV缓存,不需要重新计算大模型已经处理过的上下文,避免了重复计算。

针对E2B和E4B边缘模型,由于最终logit计算是主要瓶颈,谷歌在嵌入层引入了高效聚类技术,进一步加速生成。

在硬件适配方面,26B MoE模型在Apple Silicon上以batch size 1运行时,由于混合专家模型的路由特性,加速效果有限;但当batch size提升到4到8时,本地推理速度可提升约2.2倍。NVIDIA A100在增大batch size后也观察到类似增益。

MTP drafters现已以Apache 2.0开源协议发布,与Gemma 4保持一致。模型权重可在 Hugging Face 和 Kaggle 下载,支持 transformers、MLX、vLLM、SGLang、Ollama 等主流推理框架,也可通过 Google AI Edge Gallery 在 Android 或 iOS 上直接体验。

谷歌可能已经把这个技术扩展到全系列模型了

技术架构详解、KV缓存共享和嵌入加速的完整说明,谷歌已发布专项技术文档,可查阅官方文档了解具体用法。

https://ai.google.dev/gemma/docs/mtp/overview?hl=zh-cn

文章来自于"AI寒武纪",作者 "AI寒武纪"。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md