一篇让你看懂的AGenUI开源解读

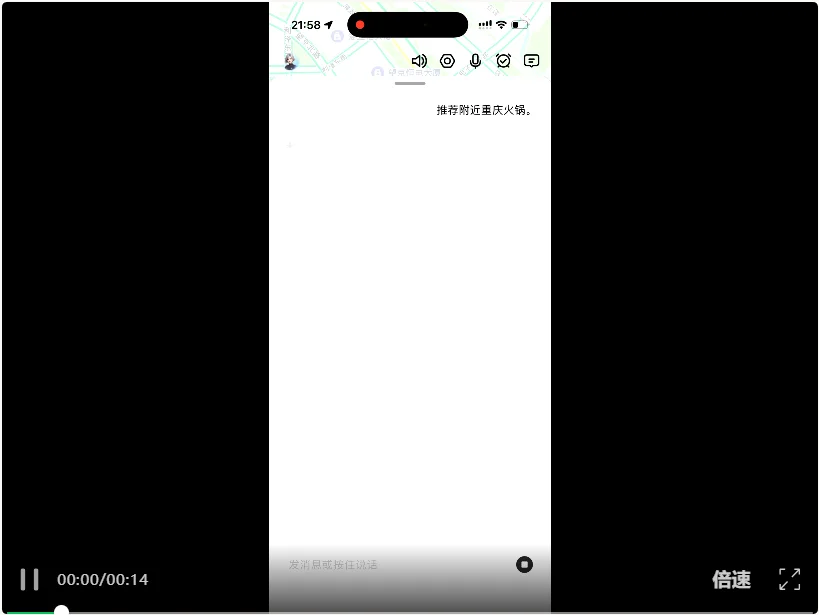

很多人对AI Agent的想象还停留在“聊天”上。你丢一个问题过去,它回你一段文字,顶多加一张图。

但真正用过这类产品的朋友应该都懂——纯文本的交互天花板太低了。你想订个酒店,它给你敲了一长串候选清单,你还要手动复制店名跳到另一个App去搜。

这不叫智能,这叫换了个地方查资料。

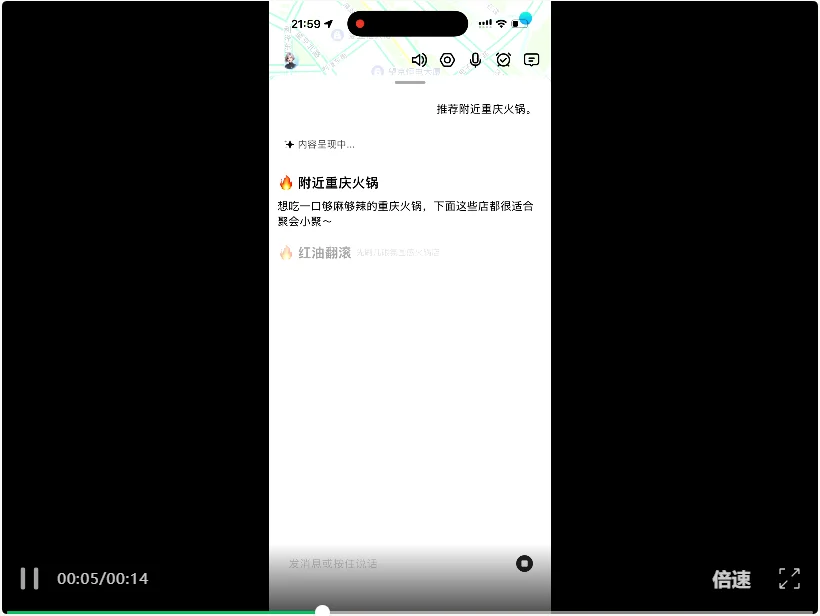

但有没有一种可能:AI直接“画”出一个带按钮、带列表、带地图的界面,让你直接在对话里完成所有操作?

高德和阿里千问C端应用团队刚刚开源的 AGenUI,就是在回答这个问题。

上周,AI圈被一个名字刷了屏——AGenUI。简单说,它是业内首个同时覆盖 iOS、Android、鸿蒙 三端的端云一体原生A2UI开源框架。

别被那一串修饰词吓跑。翻译成人话就是:

更值得玩味的是联手做这件事的两家:

最懂“落地场景”的人和最懂“模型对话”的人,决定联手解决同一个问题。

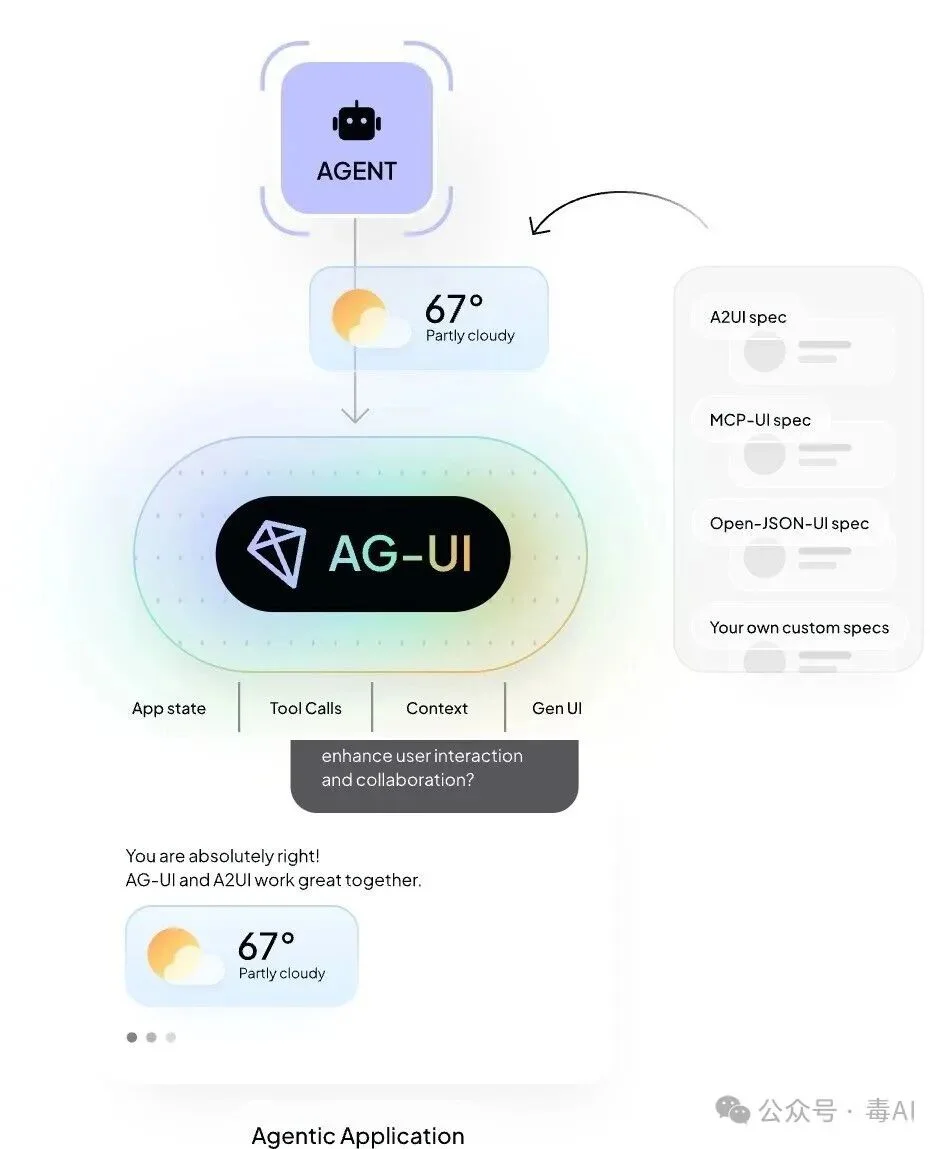

这个事有一个前情提要必须交代:Google此前开源了 A2UI协议,它定义了一种标准方式,让AI模型来描述“一个界面应该长什么样”。

但这里藏着一个尴尬的现实:

协议是定好了,可最大的坑在于——谁来把模型吐出来的那堆JSON,真的变成手机上能跑、能点、能滑的原生界面?

Google定好了一楼的设计图,但二楼到十楼的施工图还空着。AGenUI做的,就是把这几层楼盖起来。

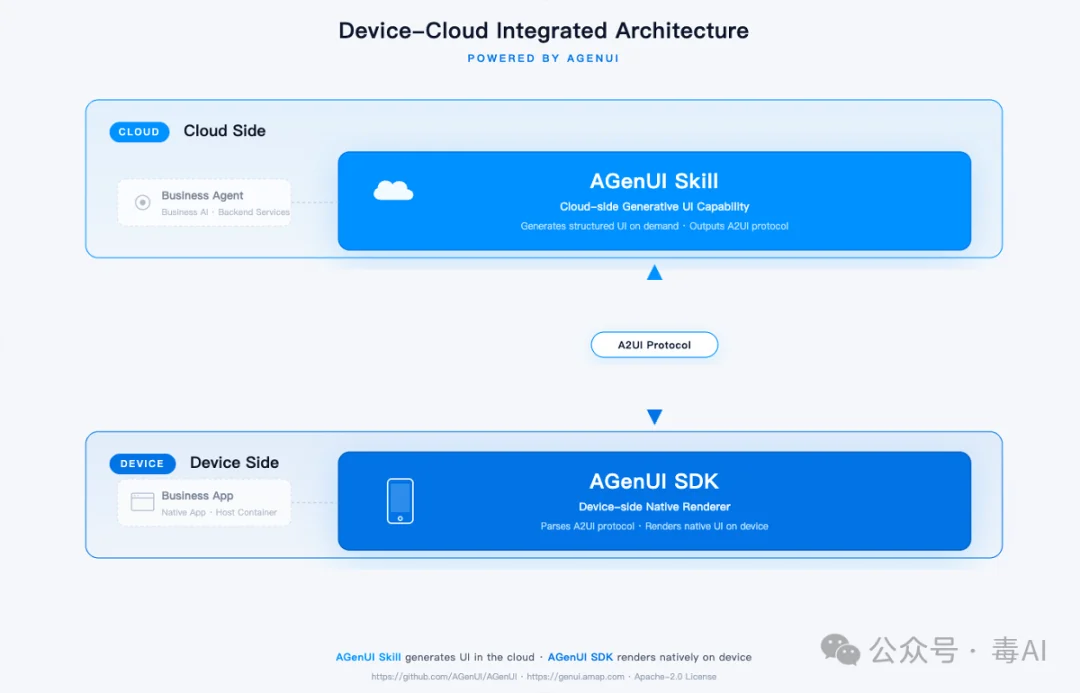

它采用了一套 端云一体架构:

所有渲染走的是原生通道。流畅度、响应速度、跟系统的手势交互,都是H5套壳方案没法比的。

用过AI生成内容的人都熟悉那种焦虑——看着光标一闪一闪,等着模型“憋”结果。如果把这种等待照搬到UI生成上,体验会是灾难级别的。

你让Agent帮你规划一个行程,结果页面先白屏三秒再一口气弹出来,这叫“智能”谁信?

AGenUI的核心采用了 Streaming-first 流式架构:

搭配 最小化节点差分更新 + 独立线程异步渲染,高频增量刷新也不会卡主线程。

AI一边想一边画,你的手指随时能滑、能点,不会被“卡住”。

以前你总觉得Agent在“后台运算”,现在你觉得它“就在眼前干活”。

写到这里有人可能会问:AI生成的界面,怎么保证跟我家产品长得一样?总不能让Agent今天生成一个蓝色按钮、明天生成一个红色按钮吧?

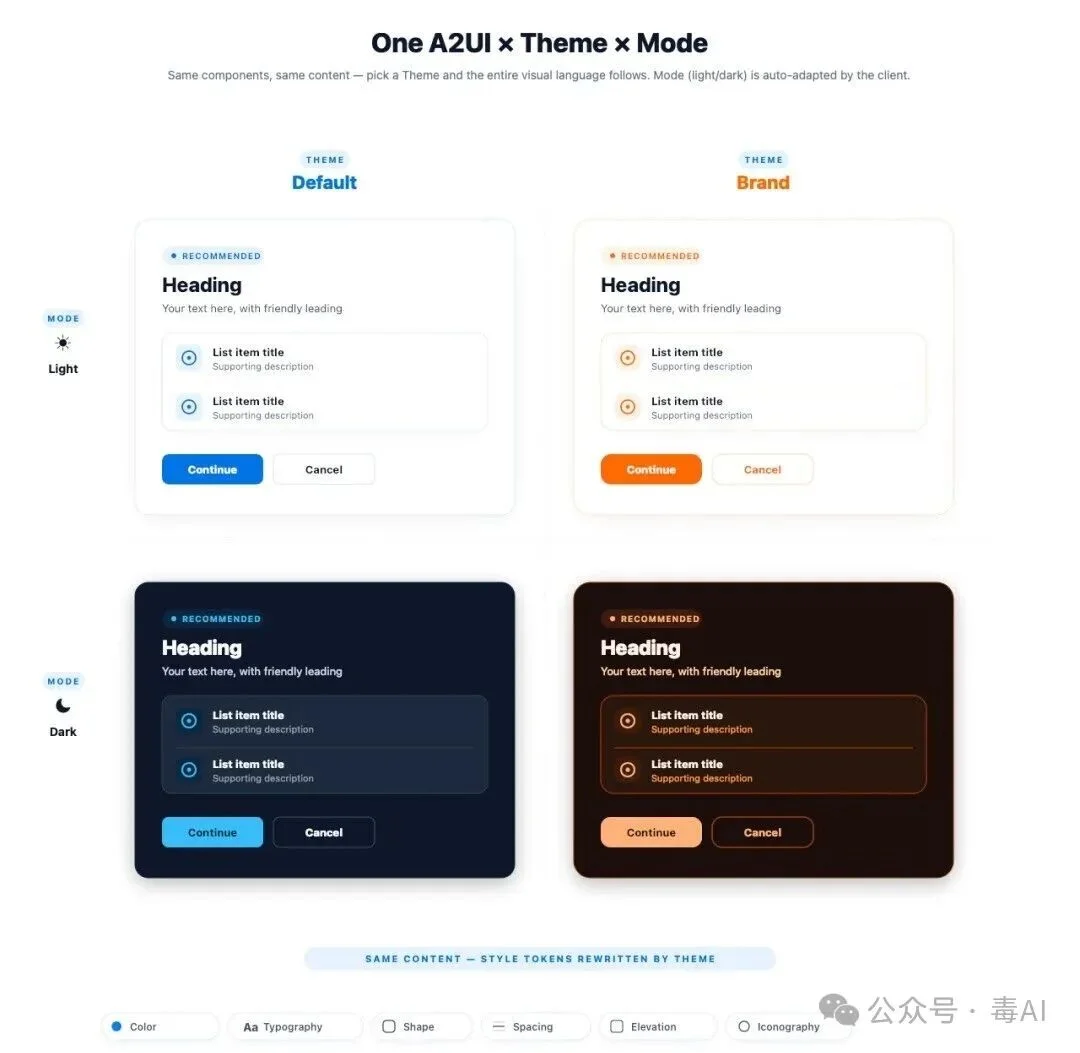

AGenUI在这件事上的解法很聪明:

关键在于它的 Theme系统 + Design Token机制:

开发者提前把品牌视觉规范注入主题系统,模型不需要操心“到底用哪个色号”,只需要输出语义化的描述(比如“强调色为品牌蓝”),端侧就会自动映射为正确的具体参数。

这其实是在“AI的灵活性”和“产品的规范性”之间划了一条清晰的分界线。

AI擅长创意和生成,不擅长遵守严格的视觉设计规范。AGenUI用一套Token机制把两条线接上了——

Agent随便生成,但最终呈现出来的东西,永远穿着你家的“衣服”。

当下的AI行业有一个微妙的分野:

AGenUI显然是后者。

它不是一个大模型,也不是一个协议,而是一套让Agent从“对话框”走向 “原生交互界面” 的基础设施。

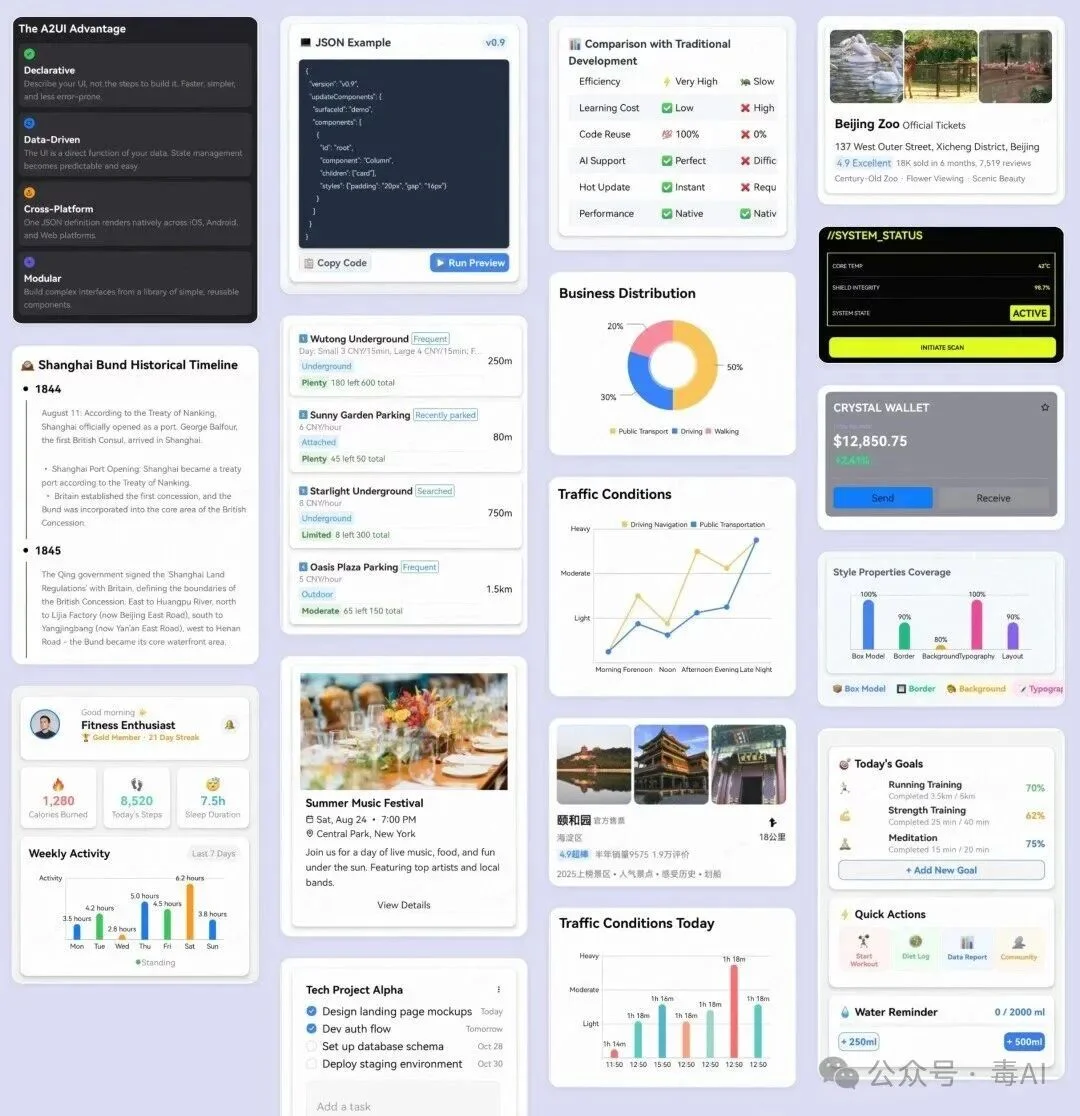

高德和千问已经完成了生成式UI链路的Demo验证,正在往真实场景里推。可以想见,未来的场景是这样的:

你在千问里说一句:“帮我在杭州西湖附近找三家茶馆,要有停车位,人均不超过200。”

你看到的不会是一段文字清单——Agent直接“画”出一张带评分、带导航按钮、带预约入口的卡片界面,你只需要用拇指点一下。

这不是科幻。这是框架已经搭好、只待工程落地的事。

对于移动端开发者来说,这可能是今年最值得关注的一个工具型开源项目——

它解决的,恰恰是所有人都在喊“Agent已来”、但终端体验还没跟上的那一道裂缝。

文章来自于"毒AI",作者 "毒AI"。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md