导读

Cursor 正式接入 Claude Opus 4.7 Fast mode——同一个旗舰模型,拆出两个速度档。快 2.5 倍,贵 6 倍,输出价每百万 token 150 美元。最离谱的是,Cursor 官方在发布当天就建议:多数任务请用标准速度。一个新功能上线,官方主动劝退,这背后藏着 AI 编程工具走向成本分层的关键信号。

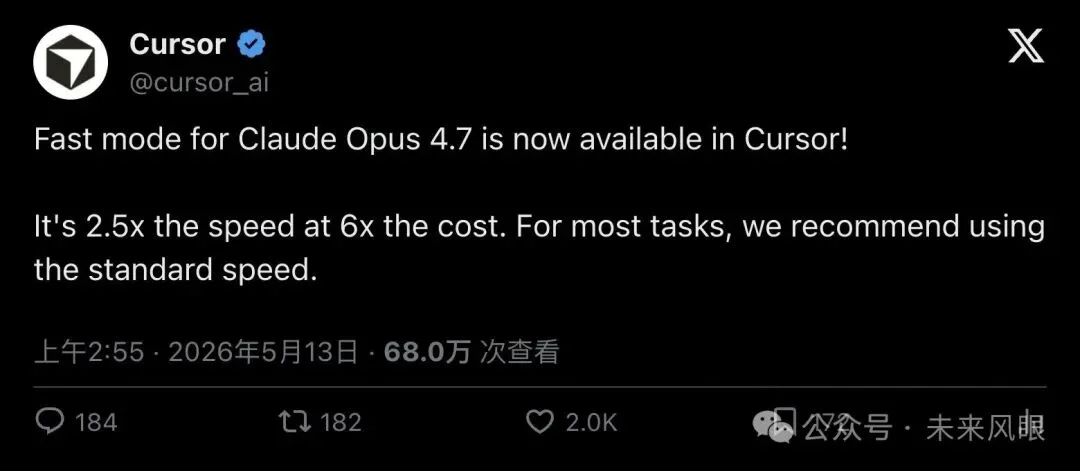

5 月 13 日凌晨,Cursor 官方账号在 X 上发了这样一条:

"Fast mode for Claude Opus 4.7 is now available in Cursor! It's 2.5x the speed at 6x the cost. For most tasks, we recommend using the standard speed."

「Claude Opus 4.7 Fast 已在 Cursor 可用!速度 2.5 倍,成本 6 倍。多数任务,我们建议用标准速度。」

▲ Cursor 官方 X 帖,68 万次查看,2000+ 点赞

这条帖子拿到了 68 万次查看、2000 多个赞。但评论区的画风很微妙——开发者们看完第一反应:你上线一个新功能,然后告诉我别用?

有人直接问:

"Why even make it available? Is there a task at which you would recommend using fast?"

「既然多数任务不推荐,那 Fast 到底为谁准备的?」

还有人说这是他一周内见过最诚实的产品文案:

"2.5x speed at 6x cost is the most honest product copy I've seen all week."

「2.5 倍速度、6 倍成本——这周我见过最实在的产品介绍。」

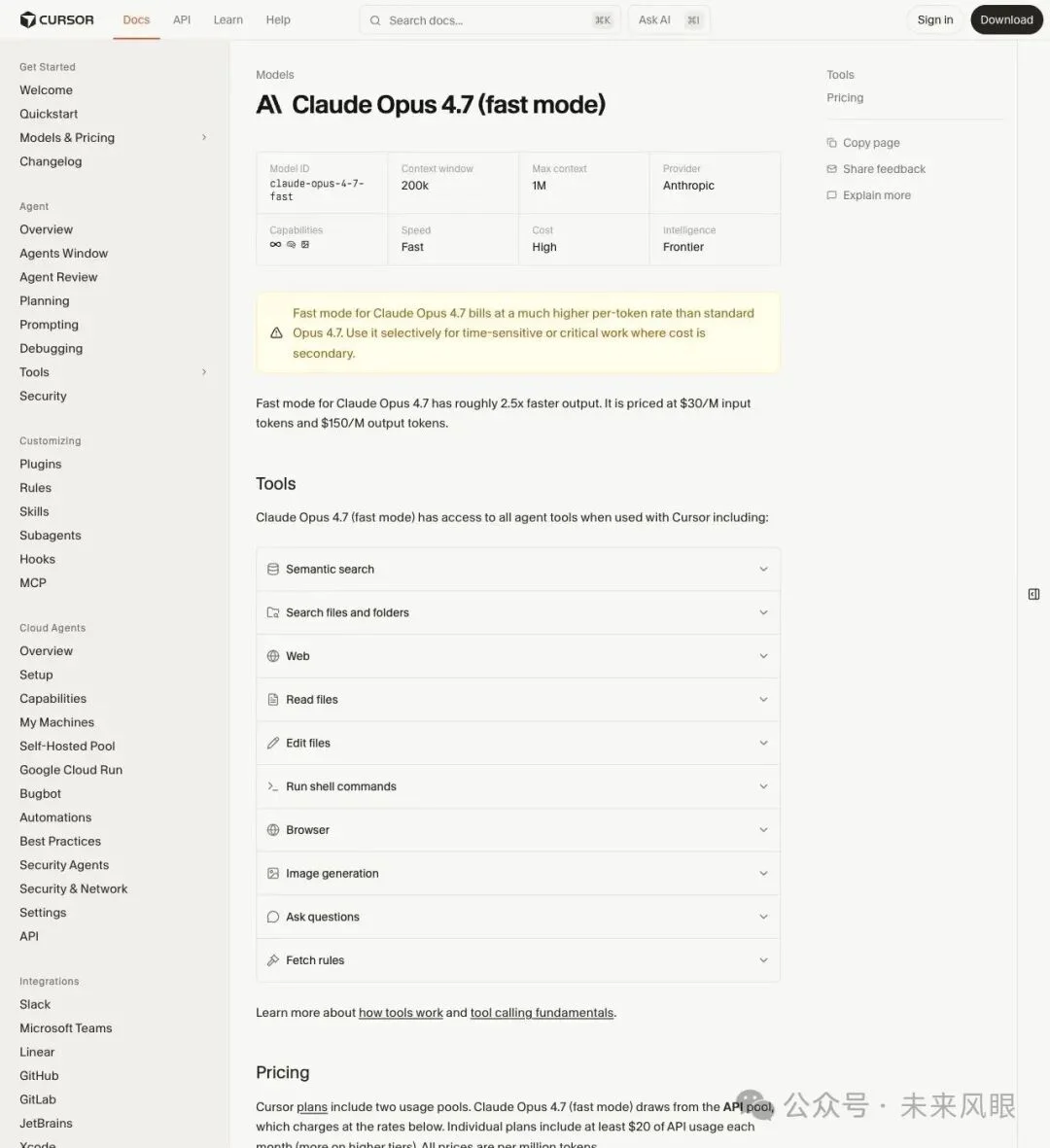

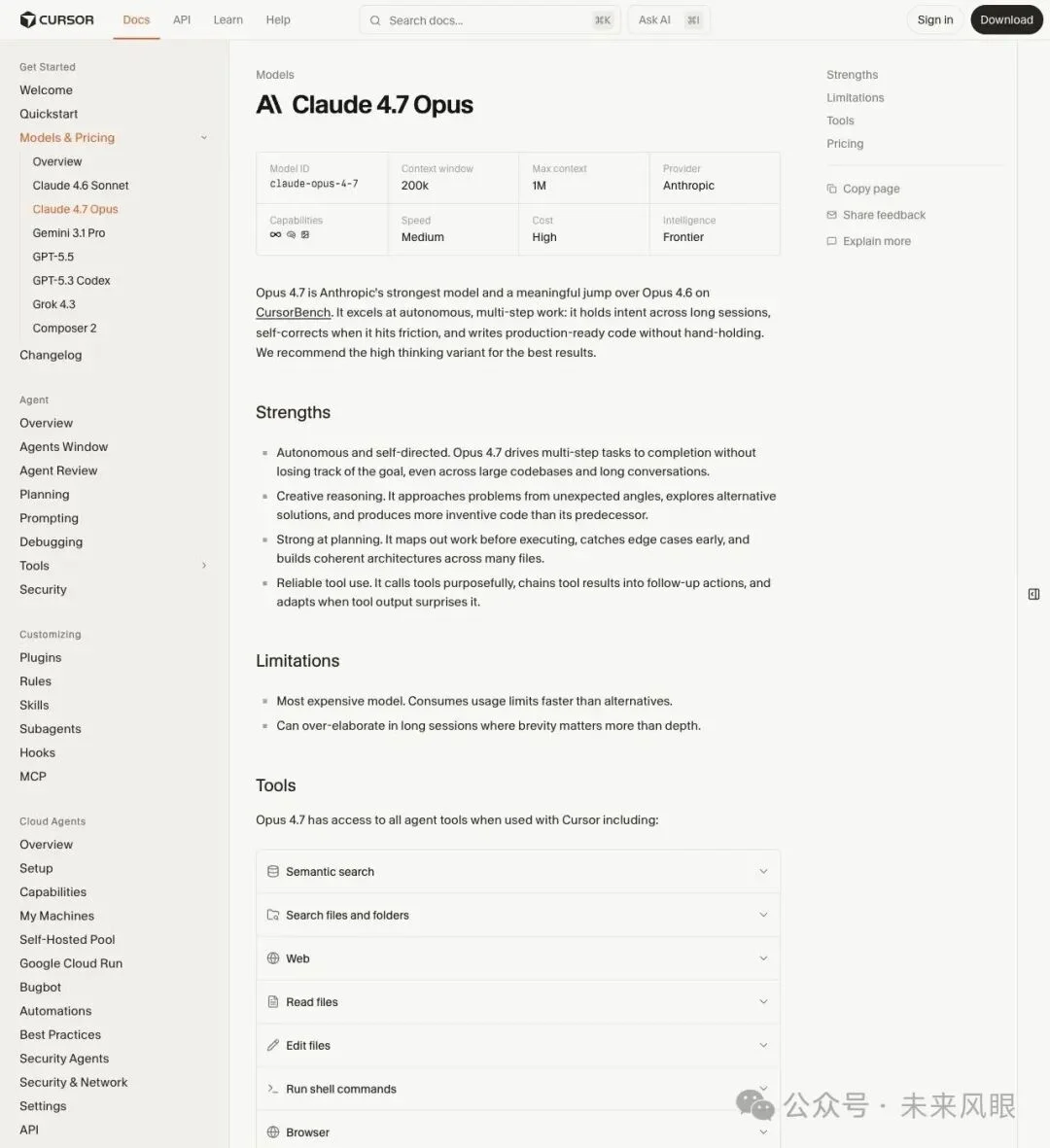

打开 Cursor 文档,Claude Opus 4.7 现在有两个 model ID:`claude-opus-4-7` 和 `claude-opus-4-7-fast`。

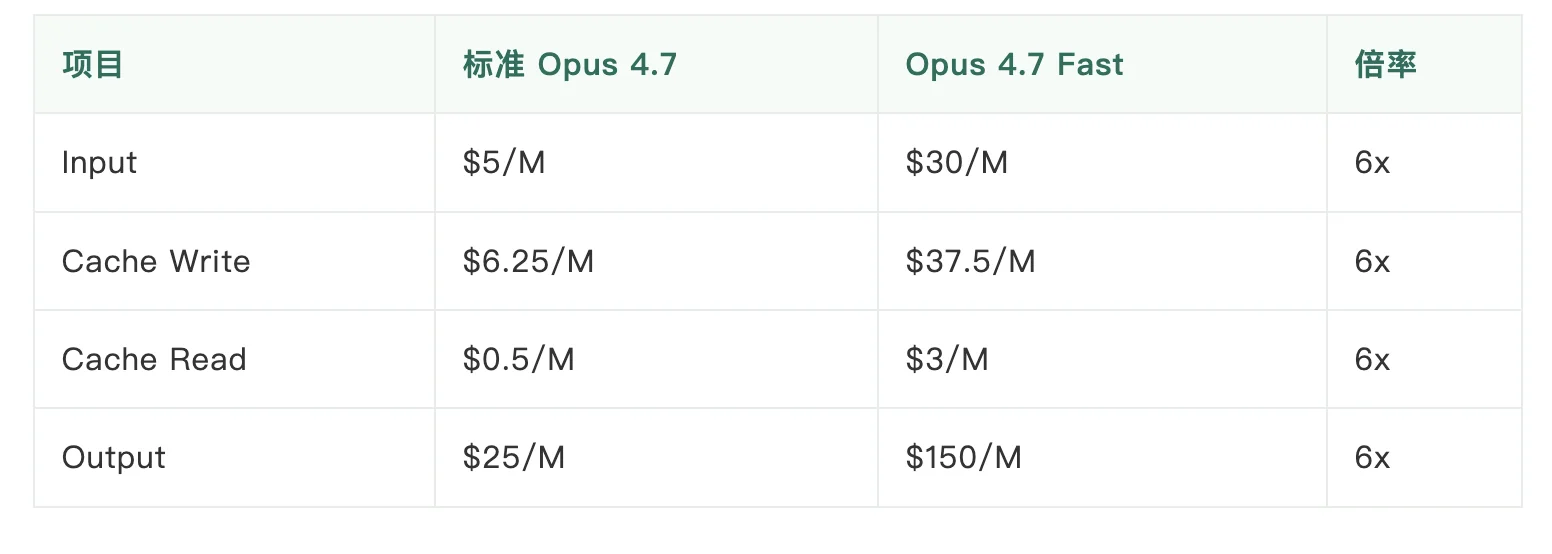

价格差距一目了然:

四项价格,全部 6 倍。

Speed 标签从 Medium 变成 Fast,Intelligence 都标着 Frontier,Context window 都是 200k,Max context 都到 1M。

▲ Cursor 文档 Fast mode 页面:model ID、价格、使用建议

▲ 对比:标准 Opus 4.7 页面,Speed 标签为 Medium

Cursor 文档原话:

"Fast mode for Claude Opus 4.7 bills at a much higher per-token rate than standard Opus 4.7. Use it selectively for time-sensitive or critical work where cost is secondary."

「Fast mode 按远高于标准 Opus 4.7 的 token 费率计费。请只在时间敏感或关键工作、成本不是首要因素时使用。」

翻译成人话就是:除非你在救火,否则别开这个开关。

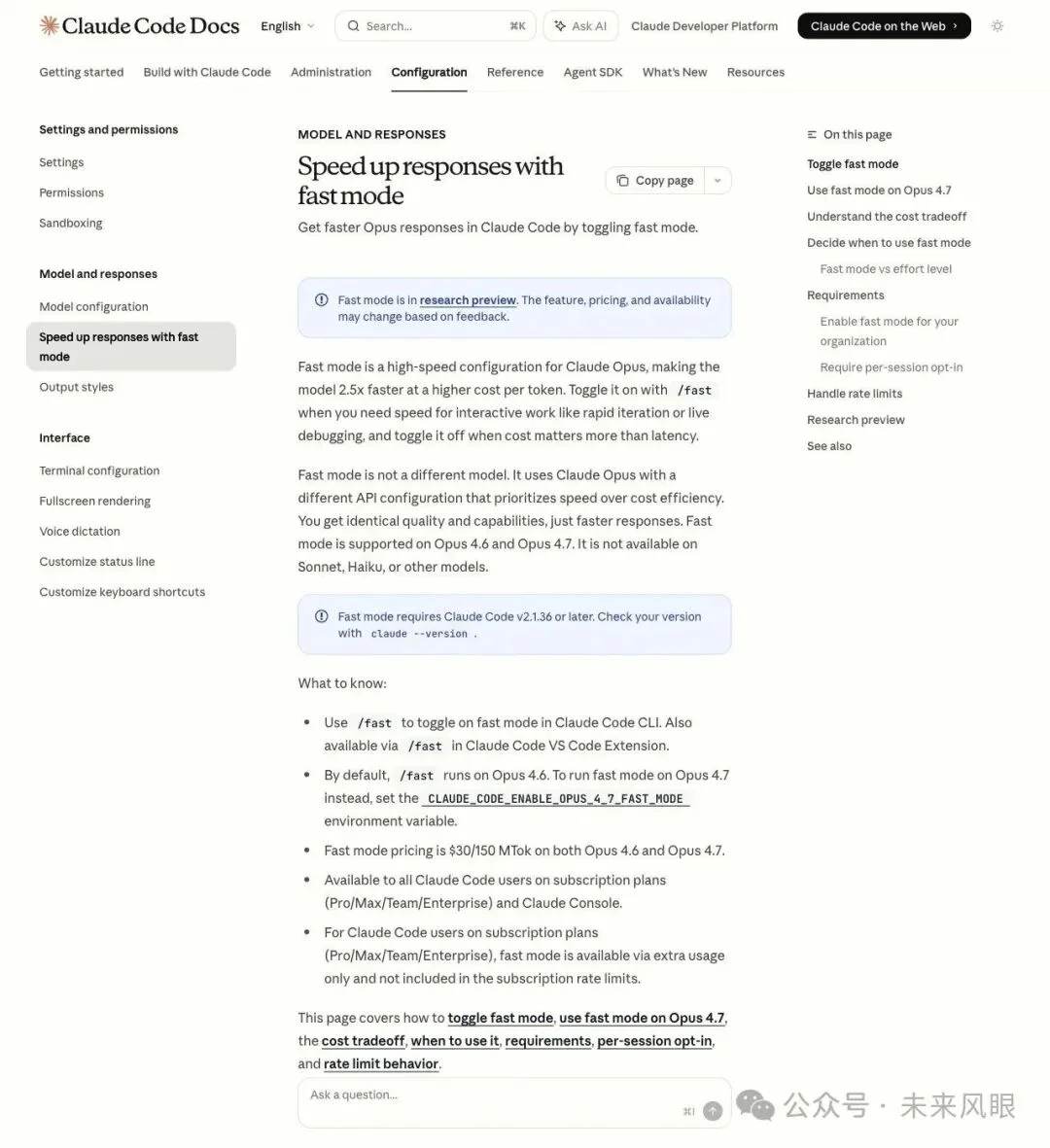

Claude Code 官方文档给出了技术层面的解释:

"Fast mode is not a different model. It uses Claude Opus with a different API configuration that prioritizes speed over cost efficiency."

「Fast mode 不是另一个模型。它用的是同一个 Claude Opus,只是换了一套优先速度而非成本效率的 API 配置。」

▲ Claude Code 文档:Fast mode 是 research preview,同一模型的不同推理配置

关键信息有三个:

第一,模型没变。Fast 跑的还是 Opus 4.7 的权重,智能水平、上下文能力完全一样。区别在推理速度——输出 token 的吞吐量提升约 2.5 倍。

第二,目前是 research preview。官方写得很明确:"The feature, pricing, and availability may change based on feedback." 价格、功能、可用性都可能随时调整。

第三,只支持 Opus。Fast mode 支持 Opus 4.6 和 Opus 4.7,不支持 Sonnet、Haiku 或其他模型。这说明快速推理配置目前只对旗舰级模型开放。

GadgetBond 的报道也指出了同样的要点:

"Fast mode doesn't introduce a new, smaller model."

"Setting the speed parameter to 'fast' on Opus 4.7 can deliver up to roughly 2.5x higher output tokens per second compared to standard speed."

「Fast mode 没有引入新的小模型。在 Opus 4.7 上把 speed 参数设为 fast,可以实现约 2.5 倍的输出 token 吞吐量。」

▲ GadgetBond 报道:same weights, different inference configuration

先看成本效率:速度提升 2.5 倍,价格涨 6 倍,算下来每单位速度的成本反而涨了 2.4 倍。这压根谈不上性价比升级,纯粹就是拿钱买等待时间。

所以适用场景其实很窄:

而以下场景,标准速度就够了:

X 上有开发者 @barishrao 总结得直白:

"6x cost for 2.5x speed... that's a brutal trade unless you're debugging a prod outage or getting paid by the hour."

「6 倍成本换 2.5 倍速度……除非你在修线上事故或者按小时收费,否则这笔买卖太残酷了。」

一个容易被忽略的点:Fast mode 走的是 API usage pool。

Cursor 文档说明,Opus 4.7 Fast 从 API pool 扣费;Claude Code 文档也提到,对订阅用户来说 fast mode 属于 extra usage,不包含在订阅速率限制内。

也就是说,如果你以为包月订阅能无限用 Fast,那得再想想。它的消耗独立计算,开了 Fast 之后你的 API 额度会以 6 倍速度烧掉。Cursor 个人计划每月包含至少 $20 API usage——按 Fast 的价格,这个额度可能撑不了几轮对话。

Cursor 社区论坛的讨论方向很能说明问题。

▲ Cursor 社区论坛:Opus 4.7 上线后的开发者讨论,10K+ views

论坛里的重度用户几乎不聊"Fast 快不快"这个话题。他们关心的是:

开发者 @PsudoMike 的建议最具代表性:希望 Cursor 提供 per-task budgets,让用户可以设定"只有当任务超过某个 token 量时才自动切换到 Fast"。用户真正想要的,是按任务价值做智能路由,不想在全开和全关之间二选一。

@ZhoWynn 看得更远:

AI 编程正在变成一个 routing problem——延迟阻塞工作流时用贵但快的模型,探索和后台任务用便宜的模型。

回看这件事的全貌:Cursor 的模型菜单里,`claude-opus-4-7` 和 `claude-opus-4-7-fast` 代表的是同一个旗舰模型的两个成本档位。

这个趋势值得注意。

过去,AI 编程工具的逻辑是"给你最强的模型"——越聪明越好,用户不用操心。现在,产品层面开始把推理成本摆上台面,让用户自己选择为速度付多少钱。

Claude Code 自己也有 `/fast` 开关,说明 fast mode 是 Anthropic 整个 Claude 生态的推理配置选项,Cursor 把它纳入了编辑器产品层。

对开发团队来说,新的关键指标正在浮现——每次 AI 辅助任务花多少钱?等多久?这次是否值得走最贵的路径?

Cursor 官方那句"多数任务请用标准速度",可能是今年 AI 编程领域最值得琢磨的产品建议。它说明一件事:推理成本已经大到产品方无法替用户兜底,只能把选择权交回去。

当 AI 编程工具开始教用户省钱,这个行业的下一阶段已经开始了。

文章来自于微信公众号 “未来风眼”,作者 “未来风眼”

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md