导读

Bloomberg 曝出重磅消息:Trump 政府正在起草一份全新 AI 安全行政令。草案中没有强制模型测试条款,也不会要求前沿 AI 模型在发布前获得政府批准,取而代之的核心方向是「自愿合作」。从 Biden 时代的强制红队测试报告机制,到如今强调企业自愿参与网络防御——美国 AI 安全监管正在经历一次路线级别的转向。

5 月 9 日凌晨,Bloomberg 记者 Andrew Curran 在 X 上发帖:

"Scoop: The White House is preparing an executive order on AI security that omits mandatory model testing and emphasizes voluntary participation by AI companies for cyber defense efforts."

「独家:白宫正在准备一项 AI 安全行政令,省略了强制模型测试,并强调 AI 公司在网络防御中自愿参与。」

▲ Bloomberg 记者 Andrew Curran 发布独家报道,1.8K 次查看

Curran 在同一 thread 里还进一步判断:

"Looks like government approval for frontier model releases may be off the table."

「前沿模型发布的政府审批,看起来已经不在讨论范围内了。」

消息来自 Bloomberg 当天的独家报道,标题一针见血:"US Prepares AI Security Order That Omits Mandatory Model Tests"(美国正在准备省略强制模型测试的 AI 安全行政令)。

▲ Webull/Benzinga 页面可见 Bloomberg 原文标题和链接

根据 Bloomberg 报道原文,这份草案的方向可以拆成两条线:

第一,让联邦机构和 AI 公司合作做网络防御。

"The Trump administration is preparing to order US agencies to partner with artificial intelligence companies to protect networks from AI-enabled cyber attacks."

「Trump 政府正准备命令美国机构与 AI 公司合作,保护网络免受 AI 驱动的网络攻击。」

第二,不会要求尖端模型获得政府批准。

"...the directive would stop short of requiring government approval for cutting-edge models, according to people familiar with the matter."

「据知情人士透露,该指令不会走到要求尖端模型获得政府批准这一步。」

报道还提到,草案将改造现有的网络安全信息共享机制(cybersecurity information-sharing programs),把 AI 公司纳入其中。新行政令的监管重心放在了网络安全信息共享和企业合作层面,而非模型发布前的审查。

要理解这份草案的冲击力,得先看 Biden 政府在 2023 年 10 月签署的 EO 14110(全称 "Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence")。

▲ EO 14110 官方文本,2023 年 11 月 1 日在 Federal Register 正式发布

这份行政令在 AI 安全领域的核心机制是强制报告 + 红队测试结果提交。

EO 14110 第 4.2 节要求:开发「潜在双重用途基础模型」(potential dual-use foundation models)的公司,必须持续向联邦政府提供训练、开发、生产和安全保障相关的信息、报告和记录——包括 AI 红队测试的结果。

EO 14110 对「AI 红队测试」的定义:

"AI red-teaming means a structured testing effort to find flaws and vulnerabilities in an AI system..."

「AI 红队测试指的是一种结构化测试,用于发现 AI 系统中的缺陷和漏洞。」

需要澄清一点:EO 14110 的实际机制是强制报告和红队测试结果提交,跟 FDA 式的「每个产品上市前都要拿批文」有区别。但在社交媒体讨论中,这套机制常被概括为「government approval for frontier model releases」——有简化,但大方向一致。

Trump 政府对这套强制报告机制的态度,从一上台就摆明了。

2025 年 1 月 23 日,Trump 就任第三天,白宫发布行政令"Removing Barriers to American Leadership in Artificial Intelligence",直接撤销了 EO 14110。

▲ 白宫 2025 年 AI 行政令:移除美国 AI 领导力的障碍

核心政策表述:

"It is the policy of the United States to sustain and enhance America's global AI dominance in order to promote human flourishing, economic competitiveness, and national security."

「美国的政策目标是维持并增强美国在全球 AI 领域的主导地位,以促进人类繁荣、经济竞争力和国家安全。」

关键词:AI dominance(AI 主导地位)。

行政令还要求各部门审查依据 EO 14110 所采取的政策、指令和法规,对不符合新方向的一律暂停、修订或撤销。

所以 Bloomberg 今天报道的这份 AI 安全草案,放在 Trump 政府的政策脉络里,方向完全一致——优先保障美国 AI 竞争力,降低监管门槛。

砍掉了强制测试和审批,那安全问题谁来管?

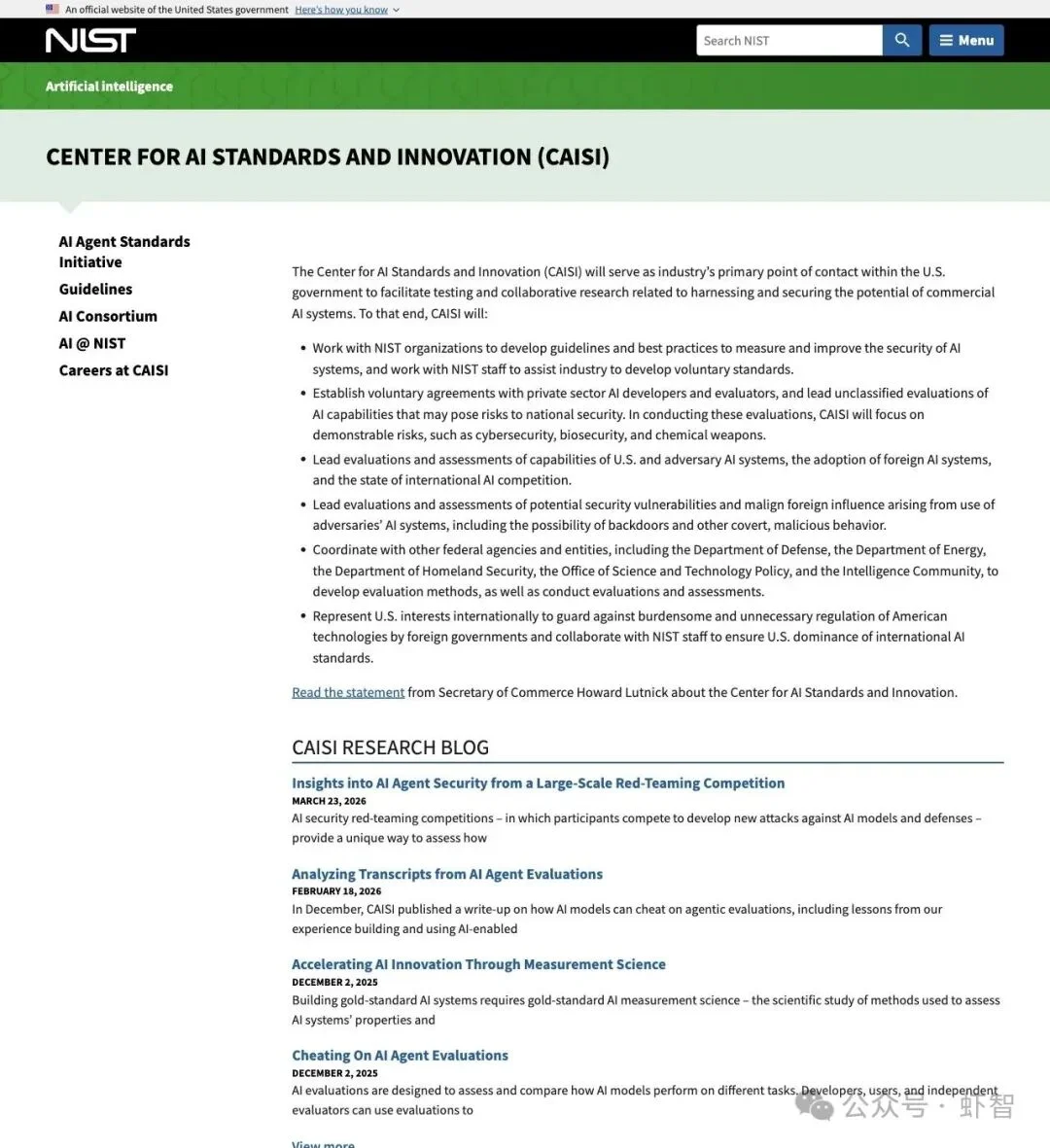

一个可能的答案指向 NIST(美国国家标准与技术研究院)下属的CAISI(Center for AI Standards and Innovation,AI 标准与创新中心)。

▲ NIST CAISI 页面:产业界与美国政府在 AI 安全领域的主要联系点

CAISI 官方页面这样描述自身定位:

"The Center for AI Standards and Innovation (CAISI) will serve as industry's primary point of contact within the U.S. government to facilitate testing and collaborative research related to harnessing and securing the potential of commercial AI systems."

「CAISI 将作为产业界在美国政府内的主要联系点,推动与商业 AI 系统能力利用和安全保障相关的测试与协作研究。」

更关键的两条职责:

"Work with NIST organizations to develop guidelines and best practices to measure and improve the security of AI systems, and work with NIST staff to assist industry to develop voluntary standards."

「与 NIST 合作制定指南和最佳实践来衡量和提升 AI 系统安全性,并协助产业界制定自愿标准。」

"Establish voluntary agreements with private sector AI developers and evaluators, and lead unclassified evaluations of AI capabilities that may pose risks to national security."

「与私营部门 AI 开发者和评估者建立自愿协议,并牵头对可能构成国家安全风险的 AI 能力进行非保密评估。」

自愿标准、自愿协议、非保密评估——这和 Bloomberg 报道中的 "voluntary participation by AI companies for cyber defense efforts" 高度吻合。

如果最终公布的行政令确实走这个方向,NIST/CAISI 很可能成为新监管框架的核心执行接口。

消息出来后,X 上的讨论迅速分化。

支持方认为这是务实选择。部分评论者表示美国不想在 AI 竞赛中被拖慢脚步,取消前置审批是 "sanity prevails"(理性回归)。Sean M. Dineen 的回复更具体:"All eyes on NIST (and I'm OK with it)"——所有目光都在 NIST 身上,他觉得可以接受。

反对方直指问责缺失。zerohedge 评论区有人写道:

"AI security order without mandatory model tests is Washington in a nutshell. Big promises, soft guardrails, zero accountability."

「没有强制模型测试的 AI 安全令,就是华盛顿的缩影——大承诺、软护栏、零问责。」

也有人选择观望。@deredleritt3r 提醒:

"I'm not counting my chickens until we see the actual executive order..."

「在看到正式行政令之前,我不会提前下结论。」

这个提醒值得注意——目前公开的信息来自 Bloomberg 的匿名知情人士和草案内容,正式行政令还没有签署。最终文本的措辞和覆盖范围仍可能调整。

争论的焦点落在一个尖锐的问题上:

如果前沿模型发布前没有任何强制测试或报告机制,政府如何判断这些模型是否在生物安全、网络安全、CBRN 等领域构成风险?

EO 14110 的设计逻辑是让企业把红队测试结果交给政府,确保联邦层面掌握基本信息。取消这套机制后,如果完全依赖企业自愿提交,动力从哪里来?

支持者的答案是:过重的审批门槛会削弱美国在全球 AI 竞赛中的位置,尤其在中国等竞争对手快速推进的背景下。NIST/CAISI 提供的自愿标准和协议框架,足以覆盖实际风险。

反对者的答案是:自愿机制缺乏强制问责,企业没有法律义务披露模型能力和潜在风险。soft guardrails 在出事之前看着都合理,出事之后就是另一回事了。

无论最终文本如何落笔,有一件事已经浮出水面:美国 AI 安全监管的重心正在从「发布前审查」向「合作式防御」滑动。这个转变的代价——或者说收益——恐怕要等到下一次 AI 安全事件时,才能真正称量。

文章来自于微信公众号 “图灵边界”,作者 “图灵边界”

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda