大家好,我是右兜。

摩根大通(J.P. Morgan)在2024年9月发布“Investable AI Summary of J.P. Morgan research and industry developments in 2024”关于人工智能(AI)2024年的研究和行业发展总结。

为了帮助读者识别我们那20,000份报告使用了现代技术来指导投资建议,我们突出了2024年上半年J.P. Morgan各个研究团队发布的47份最合适的报告。

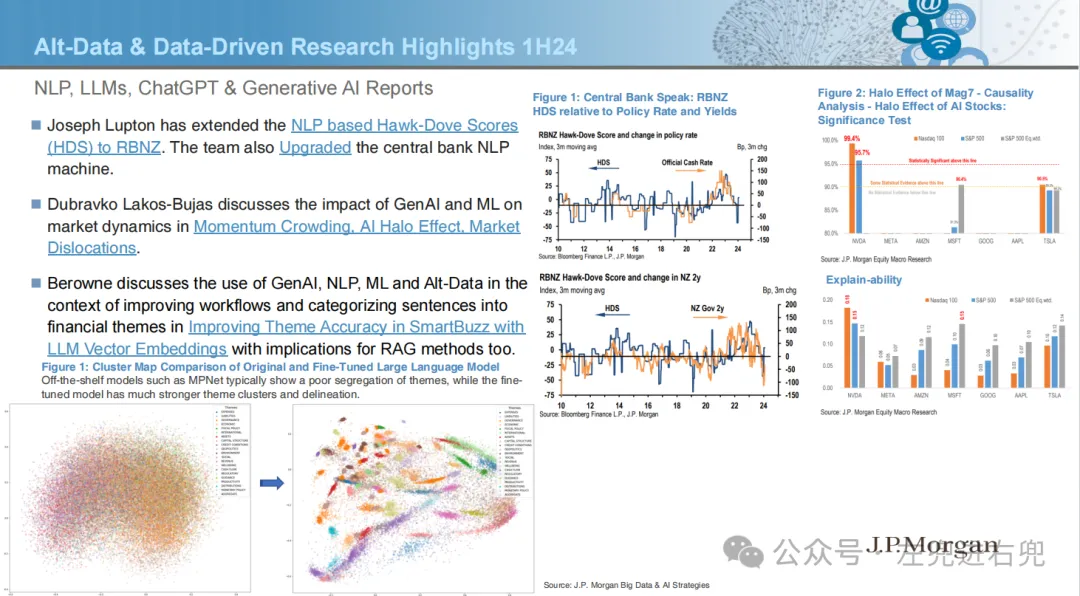

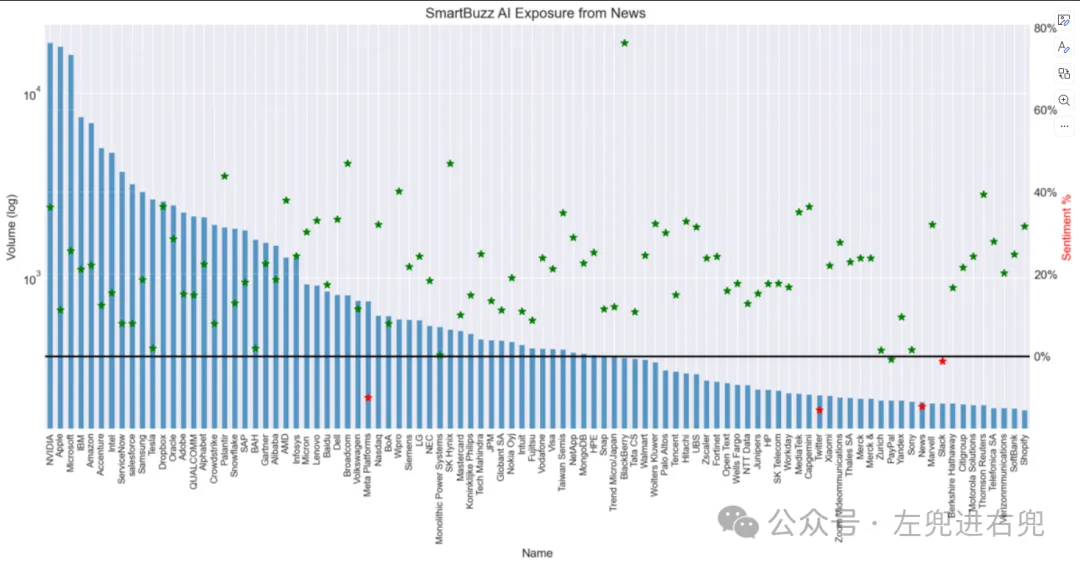

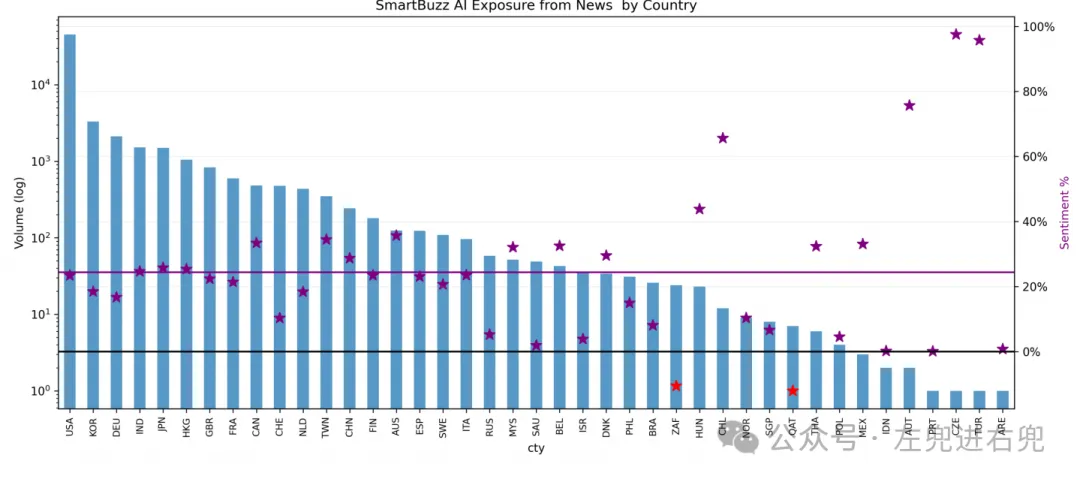

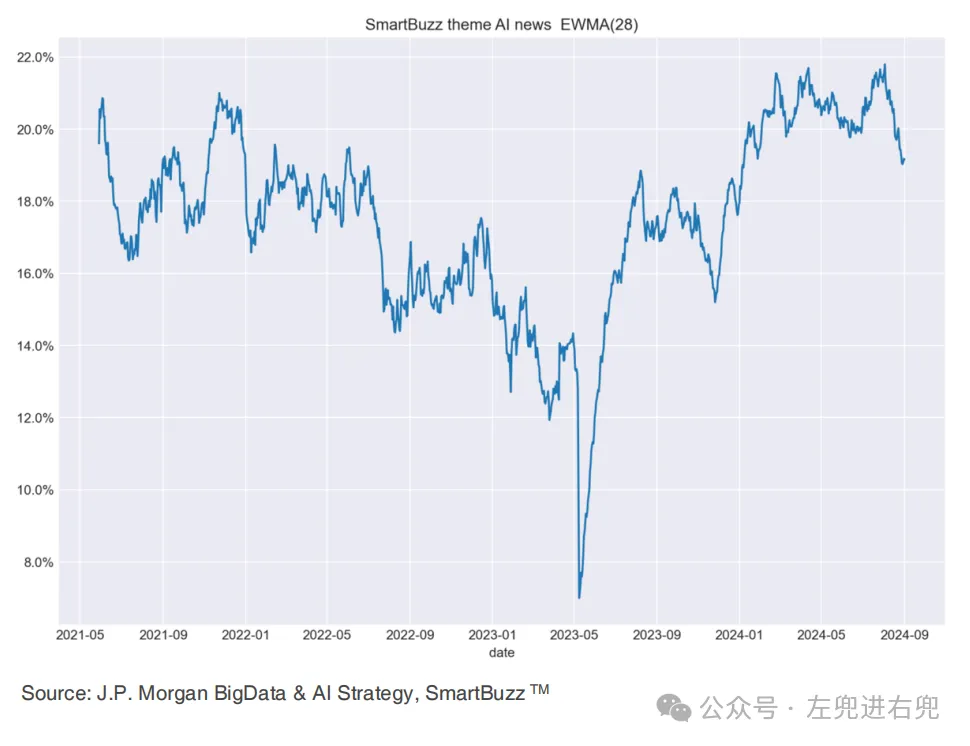

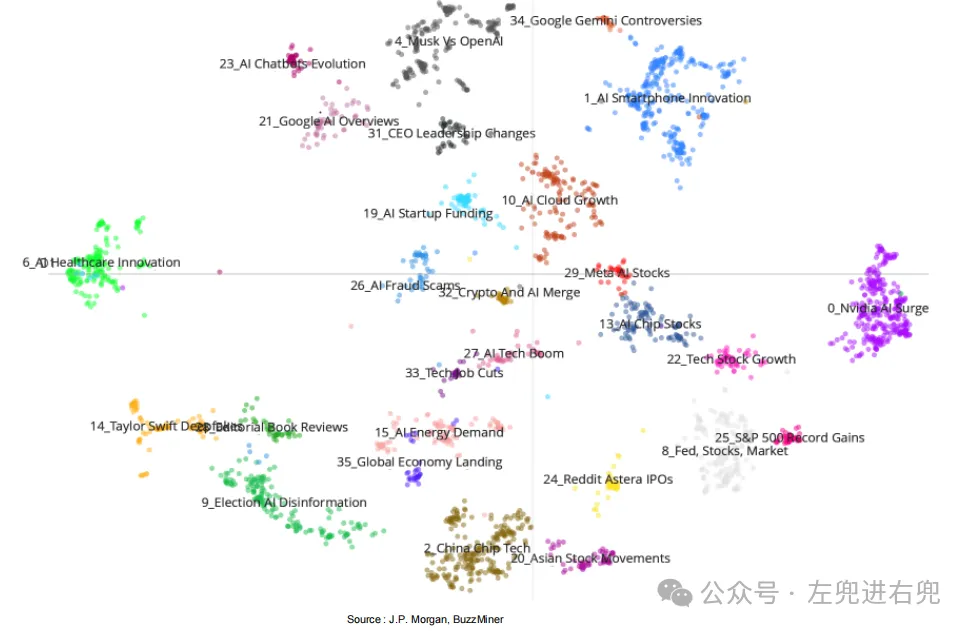

亮点包括我们定期的SmartBuzz、BuzzMiner、Mariner和中央银行模型的更新。我们将基于自然语言处理(NLP)的Hawk-Dove Scores(HDS)扩展到更多市场,现在覆盖了新西兰储备银行(RBNZ)。我们讨论了通用人工智能(GenAI)和机器学习(ML)对市场动态的影响,包括动量拥挤、AI光环效应、市场错位,并且我们使用大型语言模型(LLM)向量嵌入提高了SmartBuzz中主题的准确性。

我们使用深度学习模型进行了跨资产波动性策略的研究,并检查了量化因子投资的演变:使用ChronoML库的机器学习模型进行特征工程和系统性股票选择。我们还介绍了欧洲信贷机器学习模型(ECML),该模型用于预测欧元投资级债券的负超额回报期。

图1:原始和微调后的大型语言模型的聚类图比较像MPNet这样的现成模型通常表现出主题的贫乏划分,而经过微调的模型则具有更强的主题聚类和划分。

图1:中央银行言论:相对于政策利率和收益率的RBNZ HDS

NLP、LLM、ChatGPT 和生成性AI报告 图2:Mag7的光环效应 - 因果分析 - AI股票的光环效应:显著性检验

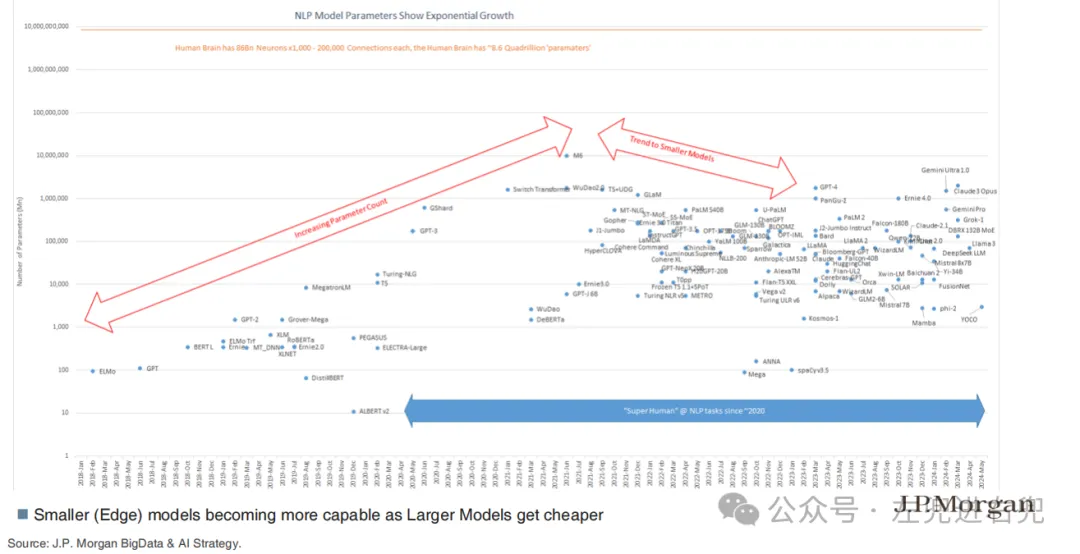

在摩根大通全球研究之外,我们策划了来自学术界和工业界的研究的关键发展,突出了在生成性人工智能(GenAI)、自然语言处理(NLP)、软件、湿件和硬件系统以及量子力学和时间序列模型方面引入的进展和重大发现。继2022年AI爆炸性的普及之后,2023年和2024年GenAI工具和大型语言模型(LLM)的持续改进标志着AI市场上的重大进步和竞争加剧。

OpenAI推出了GPTs,这是可定制的ChatGPT版本,允许用户在无需编码的情况下创建针对特定任务的定制AI助手,并即将推出GPT商店,用于分享和货币化这些创作。此后,又发布了GPT-4 Omni和搜索原型的多个版本。

Anthropic推出了Claude 3,具有先进的视觉能力、卓越的代码生成和调试、增强的可引导性以及改进的多语言流利性,为GenAI性能和成本效益树立了新的标杆。Claude 3模型系列现在支持工具使用,使其能够通过API调用与外部工具交互,执行检索文档、访问API、处理实时数据和协调子代理等任务,即使对于不完整的查询,准确率也超过90%。

苹果公司的新个人智能系统Apple Intelligence,将高能力的生成性基础模型集成到iOS 18、iPadOS 18和macOS Sequoia中,具有约30亿参数的设备端语言模型和更大的基于服务器的模型,针对效率、准确性和隐私进行了优化,应用范围从文本优化到视觉表达。

Meta-AI发布了Llama-3.1 405B,与尖端模型竞争。Llama模型受到欢迎,下载量超过3.5亿次。

IBM的最新AI助手WatsonX创新包括Z系列助手,利用通用人工智能(GenAI)和自动化技术来增强大型机管理,简化企业工作流程,并提供新的低代码助手构建功能。

xAI去年发布了Grok,今年初发布了Grok-1.5,并且刚刚宣布了Grok-2 Beta,与最好的大型语言模型(LLM)竞争。

微软的Phi-3-Mini令人印象深刻,作为一款小型语言模型(SLM),它为通用人工智能应用提供了前所未有的计算效率和成本效益,具有首款SLM中的128k上下文长度,并且完全开源。

DeepSeek推出了DeepSeek-V2,这是一款236B参数的MoE模型,带有API和专为视觉、数学和编码设计的专业模型。这些模型已经在英语和中文上训练了2万亿个token,其7B/67B基础和聊天版本是开源的,以促进社区内的研究。DeepSeek-V2是一款MoE语言模型,通过减少训练成本约40%,将KV缓存减少93.3%,并将最大生成吞吐量提高约6倍。

Codellama-70B在HumanEval基准测试中取得了67.8分的新成绩,超过了GPT-4和Gemini Pro。

Mistral的新开源大型语言模型miqu-1-70b,在SLM中接近GPT-4的性能。

Snowflake Arctic引入了一种密集MoE混合变换器,拥有4800亿总参数和170亿活跃参数,在显著降低训练成本的同时实现了顶级企业智能,并在Apache 2.0许可下开源了所有数据配方和研究见解。

Qwen,Qwen-VL来自阿里巴巴的开源小型和大型语言模型系列。Qwen-7B是阿里巴巴的第一个开源LLM,而Qwen-VL是一款视觉-语言模型,通过采用三阶段训练方法,创新地将视觉表示学习模型与LLM对齐,利用如LAION-5B这样的弱监督图像-文本配对数据,增强了泛化能力,同时保留了LLM的固有理解和生成能力。

NVIDIA的NV-Embed模型NV-Embed在大规模文本嵌入基准测试(MTEB)中取得了创纪录的成绩,通过引入潜在注意力层和两阶段学习过程,显著提高了56项任务中的嵌入准确性,而他们的Nemotron-4模型可以用作LLM或生成训练数据。

一些值得注意的技术包括“SelfDiscover”框架,它使得大型语言模型(LLMs)能够自主地识别和构建特定任务的推理结构,这显著提高了在复杂推理基准测试中的性能,并在计算需求更低的情况下超越了现有的方法,如CoT Self-Consistency。

通过嵌入量化将嵌入缩减为二进制、三元和标量格式可以更快、更便宜。

IBM的重新排名架构Re2G可以帮助将最相关的结果浮到顶部。

“Dense X Retrieval”有助于确定理想的检索粒度。

当RAG不足以应对时,知识图谱提供了知识和推理任务的下一步。

因果图谱可以通过特定的结构因果模型(SCMs)来回答问题。

有效的因果图谱发现可以借助/用于LLMs进行增强。

“ULTRA”是知识图谱推理的基础模型。

NVIDIA的cuGraph加速正在帮助革新图谱分析,甚至可以用于全球天气预报(GraphCast)和Permion。

另外,“GraphRAG”展示了一种新的复杂数据发现工具,而“Corrective RAG”(CRAG)或“RAFT”有助于忽略干扰文档。

多步骤任务依赖于RAG来获取相关信息,然后使用像LangChain这样的工具进行协调,调用代理来完成特定任务。

AI裁员已经开始:Duolingo在采用ChatGPT-4后裁员数千人,微软在中国的大规模撤离期间搬迁了数千人,而华尔街的毕业生发现入门级工作岗位已经过时。IBM也暂停了AI可以完成的工作的招聘,包括后台、人力资源和其他非客户面向的角色,UPS宣布了4000个工作岗位的裁员,这是其116年历史上最大规模的裁员。

亚马逊正在将员工从Alexa部门调到AI领域。AI技能在Intuit也很受欢迎,该公司正在裁掉10%的非AI技能劳动力,类似的转变也在发生。思科可能裁掉7%的员工,这是该公司今年第二轮裁员,因为公司将重点转移到AI和网络安全上。SAP正在重组8000个工作岗位的角色,以专注于AI驱动的业务领域的增长。

由微软和LinkedIn发布的2024年工作趋势指数强调了AI在工作场所环境中的日益融合,强调了AI驱动的生产力工具的进步,以及员工中AI素养日益增长的重要性。

AI科学家:AI科学家提供了完全自动化的科学发现,使用前沿的大型语言模型(LLMs)。该系统可以自主地产生研究思路、编写代码、进行实验、可视化结果、起草完整的论文,并模拟同行评审。

2.MOMENT:

3.MOIRAI和Chronos:

4.BiTCN和TimesFM:

5.TiDE、N-BEATS、Lag-Llama和XGBoost 2.0:

6.新的时间序列模型:

7.SOFTS和Functime:

8.StockMixer和IBM的Tiny Time Mixer (TTM):

Neuralink的最新进展:

埃隆·马斯克的Neuralink公司已经对两名人类进行了增强,其中一名在Lex Fridman的8小时播客中进行了广泛采访。

Neuralink的长期愿景:

Neuralink的长期愿景是通过显著提高通信带宽(心灵感应?)来增强人工智能与人的共生关系。

NVIDIA与脑植入物:

NVIDIA正在帮助爱德华·张博士开发一种AI脑植入物,该植入物能够恢复中风幸存者的双语交流能力。

麻省理工学院的研究:

麻省理工学院的研究提出了一个有趣的问题:我们能否在没有语言的情况下思考?

FinalSpark的“活体计算机”:

FinalSpark的科学家们将16个由人类组织制成的微型大脑连接起来,创建了一个“活体计算机”或生物计算机,该计算机在多巴胺上进行训练。

大脑解码研究:

大脑解码研究帮助我们理解视觉感知,同时其他人发布了Dendrify框架,该框架将树突整合到尖峰神经网络中。

IBM的量子十年观点:

IBM对量子十年有独到的见解,并对该类型的量子算法进行了详细回顾。

微软的量子计算应用:

微软的AI筛选了超过3200万个候选材料,以寻找更好的电池材料,使用了量子计算,同时变分量子算法被用于无约束的黑盒二进制优化。

热力学计算模式:

虽然不是量子计算,但新的热力学计算模式也可能有助于AI的发展。

小米的无人工厂:

小米正在建设一个无人工厂,并且你现在可以购买一个可穿戴硬件伙伴。

按摩机器人:

已经发布了按摩机器人,同时展望未来,GRUtopia梦想着大规模的机器人城市。

3D场景识别:

Meta的SceneScript增强了3D场景识别能力,PlatoNeRF使用两次反弹的Lidar来增强AI的空间推理能力,使机器能够解释、导航和操纵物理世界。

摩根大通网站服务:

www.jpmm.com网站为客户提供了丰富的服务,包括筛选工具和DataQuery门户网站。所有报告均可提供HTML和PDF格式,或通过PDF和RIXML格式的数据馈送。

J.P. Morgan Developer上提供了一系列API。摩根大通的研究现在可以通过亚马逊的虚拟助手Alexa访问,为公司开辟了新的传递渠道。客户可以请求Alexa向他们发送信息,如股票的速查表或特定分析师的最新研究。

可投资AI:

摩根大通最近在Morgan Markets上推出了可投资AI页面。该网站包括专门帮助您测试NLP情绪的页面,这是我们SmartBuzz产品的重要组成部分,以及找到符合您特定需求的替代数据供应商和ETF,并计划每个季度进行进一步的增强。替代数据市场覆盖了成千上万的供应商,每个供应商在股票、商品、信贷、利率和外汇方面都有多个产品。ETF页面列出了成千上万的产品,可以按地理位置、资产类别等多个相关标准进行搜索。ETF旨在通过交易单一证券,让投资者快速轻松地获得所需的市场或基准敞口。新的数据分析页面提供了一套专注于美国市场的产品,包括零售参与数据、期权伽马不平衡和CFTC期货头寸预测。

文章来自于微信公众号“左兜进右兜”,作者“右兜”

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】Fay开源数字人框架是一个AI数字人项目,该项目可以帮你实现“线上线下的数字人销售员”,

“一个人机交互的数字人助理”或者是一个一个可以自主决策、主动联系管理员的智能体数字人。

项目地址:https://github.com/xszyou/Fay

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【部分开源免费】FLUX是由Black Forest Labs开发的一个文生图和图生图的AI绘图项目,该团队为前SD成员构成。该项目是目前效果最好的文生图开源项目,效果堪比midjourney。

项目地址:https://github.com/black-forest-labs/flux

在线使用:https://fluximg.com/zh

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales